人工知能(AI)

-

生成AIで驚きのセラピー効果? 訓練データが成否を分ける

-

生成AIによる精神疾患治療、初の臨床試験で「人間並み」効果

-

徳井直生:生成AIは究極の消費ツール 創造的に付き合うには

-

今井翔太:予測困難な生成AI技術の進化 急変する世界にどう備えるか

-

AIデータセンター 中国でバブル崩壊か? 需要低迷で大量放置の実態

AIインフラに大量の資金が流れ込んだものの、投機的な投資と需要の低迷が衝突。ディープシーク(DeepSeek)登場でトレンドが変わり、中国のデータセンター・バブルは崩壊しつつある。

-

トランプ反発でAIでも「脱・米依存」へ 技術主権確立の動き

米国の姿勢変更を受けて、欧州をはじめとする各国の政治家やビジネスリーダーの一部は、米国技術への依存を見直し、自国発の代替策を模索し始めている。AI分野でもそうした動きが目立ち始めた。

-

「きれい」から「使える」へ、チャットGPTが画像生成を刷新

オープンAIが新しい画像生成ツールをリリースした。チャットGPTから利用できる。実用性に重きを置き、特定のオブジェクトを調整できる機能を持ち、画像の中に正確に文字を入れることも可能になった。

-

「AIがやりました」 便利すぎるエージェント丸投げが危うい理由

-

AIを取り込むロボット企業、ロボットに進出するAI企業

-

チャットGPTとの対話で孤独は深まる? オープンAIとMITが研究

-

無法地帯のAIコンパニオン、責任は誰に? 訴訟、依存症問題も

-

安心・安全なAIを目指して——AI規制の国際潮流と日本企業の役割

-

グーグルがロボット向けAIモデル、口頭指示で折り紙も

グーグル・ディープマインドは、大規模言語モデルをロボット制御に組み込んだ新たなAIモデルを発表した。さまざまなタスクを一般化できるロボットの実現に向けた大きな前進である。

-

機械化する「私」たち AIロボット時代の 人間性を問う3冊

ロボットと人間の境界が曖昧になる現代。3冊の新刊から見えてくるのは、テクノロジーに寄り添うほど機械化していく私たち自身の姿だ。

-

AIボット、無法地帯に 未成年セレブになりすまし、 不適切な会話・画像も

-

膨らんではしぼむ「AGI」論、いまや夕食時の話題に

「汎用AI」を巡る期待と失望のサイクルが続く中、その議論は専門家のコミュニティを超え、一般家庭の夕食時にも取り上げられるほど広がっている。ただ、その定義をはっきりさせることが重要だ。

-

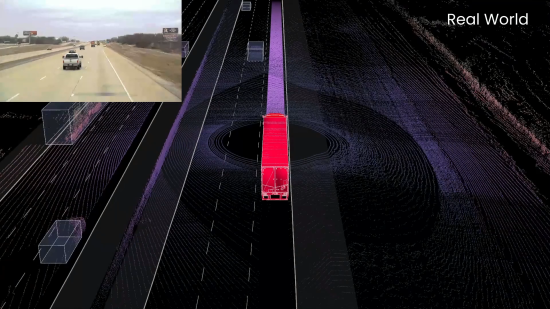

「想定外」の事態も想定、 実世界と99.7%一致する 自動運転シミュレーション

-

ディープシークの衝撃再び? 話題の中国製AIエージェントを試してみた

-

「画一」が損なう公平性、 AIのバイアス軽減で スタンフォード大が新指標

スタンフォード大学の研究チームが、AIモデルの公平性を評価する新しいベンチマークを開発した。従来の「すべてのグループを同一に扱う」アプローチでは、むしろ不公平な結果を生み出す可能性があるという。

-

中国で「AI占い」ブーム、ディープシークが引き金に

不安と悲観が広がる中国社会で、若者たちが伝統的な占術とAIを融合させた新たな流行に熱中している。占いとの相性の良い国産大規模言語モデル「DeepSeek-R1」の登場もブームを牽引している。

-

監視される労働者、職場に忍び寄る「生産性ツール」の影響

-

最新AIモデル、勝つためなら手段選ばず チェス対局で明らかに

-

限界説に挑むオープンAI、最後の非推論モデル「GPT-4.5」

オープンAIは大規模言語モデル(LLM)の最新版となるGPT-4.5をリリースした。規模の拡大で性能向上を目指す同社の古典的なアプローチにおける、最後のリリースになる可能性がある。

-

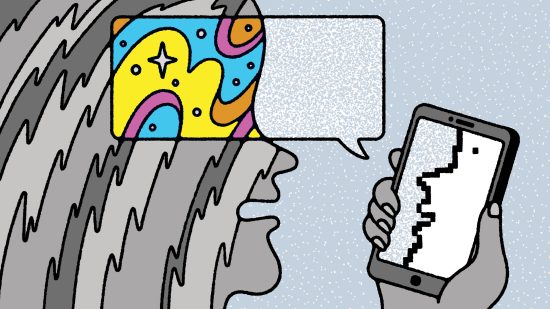

始まったAI人間関係革命、 世界の「普通の人」は どう使っている?

AIチャットボットは、私たちがお互いにつながる方法、そして自分自身とつながる方法を急速に変えつつある。そして、この潮流はもう後戻りすることはないだろう。

-

中国EVメーカーが人型ロボットへの転換を急ぐ裏事情

中国で電気自動車(EV)を製造販売している企業の多くが、人型ロボット(ヒューマノイド)に投資している。EV同様に低価格で製造し、世界市場での普及を目指しているが、これはどのような意味を持つのだろうか。