人工知能(AI)

-

AI訓練データに個人情報、 身分証や履歴書など数百万件

-

AIモデルから消えた「医師ではありません」、診断まがいも

-

AI企業が米国の教育現場に猛アタック、教員向けに研修へ

オープンAI、アンソロピック、マイクロソフトは米国の教員組合と提携し、教育現場へのAI導入を支援すると発表した。教員向けに研修を提供する計画だが、期待した効果は得られるだろうか。

-

高品質で超高額、グーグル動画生成AI「Veo 3」で謎の字幕問題

グーグルが5月に発表した動画生成AI「Veo 3」で、ユーザーの指示を無視して意味不明な字幕を勝手に生成する問題が発生している。特に「売り」である、セリフを含むシーンの生成で頻繁に発生しているようだ。

-

サンフランシスコの次は? 4つのグラフで見る、 米国都市の「AIへの備え」

-

AIに声を「忘れさせる」新技術、なりすまし防止へ機械反学習を応用

韓国の研究チームが「機械反学習」でAIモデルから特定の音声を取り除く技術を開発した。数秒の音声で誰でも複製できる音声合成技術の悪用を防ぐ新手法として注目される。

-

アーティストvs AI第2ラウンドへ、防御ツール破る新技術

-

AIで人間の心を理解できるか? ニューラルネットが挑む心理学の新境地

心を理解することは難しい。脳を真似たニューラルネットワークで人間の行動を予測させることで、心の内面の働きに関する新たな理論を構築できる可能性を示す論文がネイチャー誌に発表された。

-

期待先行のAIエージェント、誇大宣伝で「バブル崩壊」のリスク

AIエージェント技術には膨大な可能性がある。だが、用語に対する明確な定義もなく、現実とのギャップも大きい。誇大宣伝が先行すれば、過去の多くの技術トレンドと同様に、ユーザーの失望を招くことになるだろう。

-

AIブームに乗り遅れた IT大国・インドの焦り、 国産モデル開発に本腰

-

AI著作権訴訟でメタとアンソロピックが初勝利、今後の展開は?

アンソロピックとメタは6月下旬にそれぞれ、AIモデルの訓練における著作権侵害を争った訴訟で有利な判決を勝ち取った。この種の訴訟で初めて出された重要な判決ではあるが、それぞれの判断理由は異なっている。

-

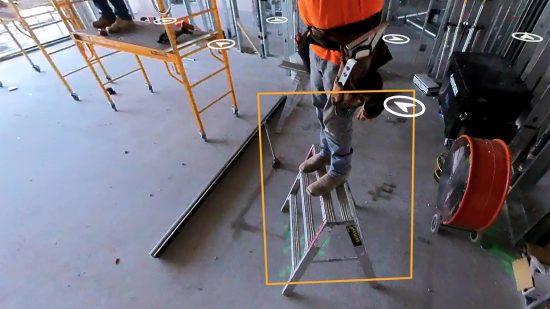

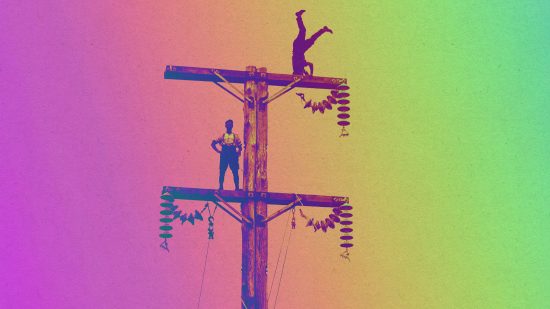

危険行為を自動検出、 生成AIは建設現場の 命綱になるか?

米国の建設現場では年間1000人以上が業務中に転落などの事故で死亡している。こうした悲劇を防ぐため、生成AIを活用した安全監視システムが登場している。AIは本当に作業員の命を救えるのか。

-

AIベンチマークはもはや限界、新たなテスト手法の登場相次ぐ

AIの性能を測るための従来のベンチマークはもはや限界に達しつある。研究者たちは、AIをテストするための新しい、より良い方法を考え出そうとしている。

-

中国VC、実用性重視のAIベンチマークを一部無料公開

中国のベンチャーキャピタル企業は、AIモデルの学術的な能力だけでなく、実世界のタスクを遂行する能力について評価できるベンチマークテストを作成した。一部は無料で公開され、定期的に更新される予定だ。

-

「お堅い」Claude、性的会話に応じやすいAIモデルは?

-

オープンAIが目指す「iPhoneの次」に期待すべきではない理由

-

AIモデル「問題児」、わずか100件のデータで更生=オープンAI

-

「生成AIはコピー機」 という主張から考える 創造性の原理

-

大規模モデルはやっぱり強かった——AIエージェント、交渉結果に差

-

何でもやってくれる AIエージェントに あなたは「鍵」を渡せますか

-

「Manus」が火付け役、 中国発AIエージェントは 世界を席巻するか?

中国のスタートアップが開発した「Manus(マヌス)」はAIエージェントブームを巻き起こした。これを皮切りに中国では汎用AIエージェント開発ラッシュが始まり、海外進出を狙う動きが活発化している。

-

米国防総省の安全性テスト部門が縮小、AI兵器の導入加速へ

米国防総省は兵器やシステムの安全性をテストし評価する運用試験評価局の人員をおよそ半分に削減した。AIの軍事導入が進む中、戦闘中に表面化する問題を見逃してしまう可能性がある。

-

転んだらどうする? 人型ロボットの安全基準づくりが進行中

身長1.8メートル、体重65キロの人型ロボットが突然転倒したら——。従来のような緊急停止が通用しない人型ロボットの安全基準づくりが急ピッチで進んでいる。

-

動画生成は別次元、思ったより深刻だったAIの電力問題

-

数学オリンピックで「人間超え」のAIは数学者になれるか?

大規模言語モデルが苦手としていた数学の能力を急速に向上させている。AIはいずれ、プロの数学者でも解けないような問題を解けるようになるのだろうか。