人工知能(AI)

-

見よう見まねでエビ料理を作る自律型ロボット(動画あり)

スタンフォード大学の研究グループが、遠隔操作で覚えたタスクをこなすAIロボットを開発した。安価なハードウェアでも複雑なタスクをこなすことができ、エビを調理したりフライパンをすすいだりできる。

-

生成AIブームから1年、2024年はセキュリティにも注目を

2024年はAIにとってどのような年になるだろうか。MITテクノロジーレビューのこれまでの記事などに基づいてまとめてみた。

-

「地震予知」は どこまで進んだのか? 機械学習が開く可能性

地震予知は以前、地震研究の主流の枠から外れていた。しかし現在、多くの科学者が機械学習やその他の手法を応用し、人々に安全確保の時間を与える地震予知の実現を目指す研究を進めている。

-

2024年のAI業界で何が起きるか? 本誌が予測する4大トレンド

変わり続けるAI分野において2024年に注目すべき4つのホットなトレンドを、MITテクノロジーレビューの編集者が大胆予測。話題の中心は、引き続き生成AIだ。

-

生成AI革命で残された 6つの課題

2023年、生成AIは世界を席巻したが、未解決の問題も残っている。生成AIの未来、そして私たちの未来は、私たちが次にどうするかで決まってくるだろう。

-

LLM時代の言語危機に立ち向かうアフリカのスタートアップ

チャットGPTをはじめとするAIモデルは多様なアフリカの言語をほとんど理解できない。こうした現状を変えるべく、複数のスタートアップが、アフリカの人々に役立つAIを構築しようと取り組みを進めている。

-

激動の「生成」ブームに揺れた2023年のAIシーンを振り返る

-

主張:生成ブームでも結局、AIは巨大テック企業に支配されている

オープンAIの騒動で明らかになったのは、AI業界における巨大テック企業の影響力だった。当局による規制も、資金力と影響力を利用して自身に都合よいものにしてしまう可能性がある。

-

生成AIアシスタントは プログラマーの仕事を どう変えているか

生成AIによるコーディング・アシスタント機能が高機能化し、実際に利用するプログラマーが増えている。AIアシスタントはソフトウエア開発にどれほどの違いをもたらし、業界にどのような影響を与えるのだろうか。

-

iPhoneで事前学習、家事ロボット新手法は成功率81%

家庭用ロボットの実用化には、大量の訓練用データをいかに用意するかという課題がある。ニューヨーク大学の研究チームは、iPhoneを使ったデータ収集方法を新たに考案。30日にわたってテストした。

-

ディープマインド、大規模言語モデルで数学の未解決問題を解く

グーグル・ディープマインドは、大規模言語モデル(LLM)で純粋数学の有名な未解決問題を解くことに成功したと発表した。LLMが、訓練データに含まれない未知の解を導き出すことに成功した例になる。

-

AIがもたらす「今そこにある危機」と闘う研究者

-

主張:未来の脅威よりも深刻な現実のAI被害を直視すべき理由

先駆的なAI倫理の研究で知られるジョイ・ブオラムウィニ博士は、将来の危機を恐れるあまり、AIシステムがすでに人々を傷つけている事実が見えなくなっていると主張する。

-

人工「超知能」暴走防止へ、 オープンAIが初成果を発表

-

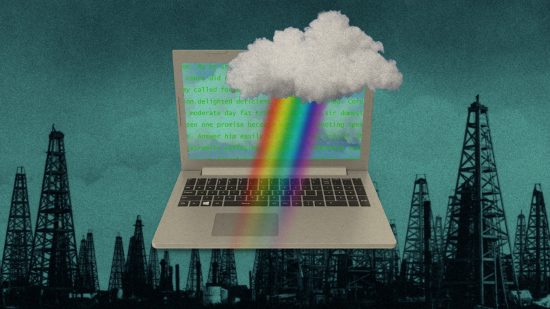

予想以上に多かった、生成AIの二酸化炭素排出量

-

AI画像生成のエネルギー消費量、スマホのフル充電に匹敵

-

欧州以外も無関係ではないEU「AI法」 5つの重要ポイント

2年半にわたって協議されてきたEUの「AI法」がついに合意に達した。重要かつ法的拘束力を備えた、透明性と倫理に関する規則の先駆けとなる、世界初の包括的なAI規制だ。

-

「分からなかったら聞いて」を実践するロボット新技術

-

単独ロングインタビュー サンダー・ピチャイが語る GeminiとAI新時代

-

グーグルがGPT-4対抗「Gemini」投入、AIの限界広げるか

-

ディープマインドが材料革命、700以上の新材料をAIで探索

-

中国テック事情:回答拒否率も規定、驚くほど具体的な生成AI規制案

中国政府機関が生成AIの規制に関する草案文書を発表した。同文書は、テック企業が実施すべきセキュリティ評価とその評価基準について、非常に具体的な方法を明確に示しており、参考になりそうなところも多い。

-

独占:アルトマン解任前夜、 渦中の人物が語っていた 人工超知能への期待と恐怖

-

算数が解けるオープンAIの噂の新モデル「Q*」、専門家の見立ては

-

アルトマン解任→復帰、オープンAI「激動の4日間」が残したもの

11月17日のサム・アルトマンCEOの電撃解任に始まったOpenAIの内紛は、紆余曲折を経てアルトマンのCEO復帰という形で決着を迎えた。17日からの4日間の経緯と業界に与えた影響を説明する。