人工知能(AI)

-

生成AIブームの先にある 知的ロボットへの道、 データ争奪戦が始まった

生成AIが席捲する中、次なる目標として知的ロボットの実現への関心が高まっている。実現には大量の実世界のデータが必要だ。企業や研究者たちはより多くの訓練用データを手に入れようと躍起になっている。

-

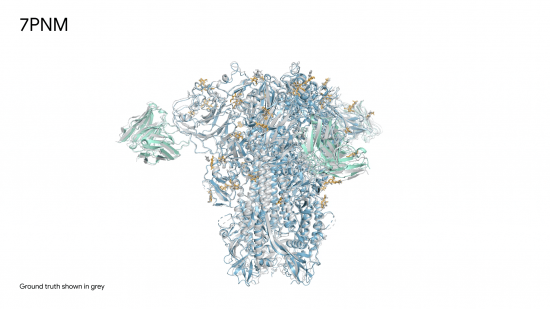

グーグル、AlphaFold 3を発表 生命分子の構造を予測

グーグル・ディープマインドは、DNAやRNAなどの生命分子の構造と相互作用を予測できるAIモデル「AlphaFold 3」を発表した。創薬および研究分野におけるAIの利用をさらに推進する。

-

クジラの言語構造、想像以上に人間の言語に近かった

-

「自動運転2.0」アーカイブ配信(チューリング 青木俊介CTO)

生成AIは停滞する自動運転業界の突破口になるのか。MITテクノロジーレビューが4月24日に開催したイベントのアーカイブ動画を、有料会員限定で特別配信する。

-

故人のSNSもAI訓練に?「球切れ」で過熱するデータ争奪戦

生成AIブームによってデータ争奪戦が激しさを増している。ネットから無料で収集できる訓練データが枯渇しつつある今、テック企業は新たな金鉱を探している。

-

サム・アルトマンが語った スマホ超えAIツールの姿 「人生を完全に把握」

-

AIが創る「もう1人の私」 リアルすぎる動画の 制作過程を本誌記者が体験

-

AIアバターやエージェント、EmTechで印象に残ったこと3つ

MITテクノロジーレビューが4月にロンドンで開催したカンファレンスでは、より優れたAIアバターやAIエージェントなど、AIの今後の展開に関する知見が得られた。

-

解説:米国がイスラエル、 ウクライナ、台湾に提供する 防衛技術はこれだ

イスラエルやウクライナ、台湾への軍事支援を含む950億ドルの包括的支援計画が米国議会で可決された。今回の支援において重要になる4つの軍事技術について専門家が解説する。

-

AIチャットボット向け「うそ発見器」、LLMの幻覚見抜く

チャットGPTのような大規模言語モデルを企業で利用する際に問題となるのが、ハルシネーション(幻覚)だ。MIT発のスタートアップは、モデルの回答がどの程度信頼できるかを示すツールを開発した。

-

未来の職種:LLMを操る「プロンプト・エンジニア」は生き残るか

-

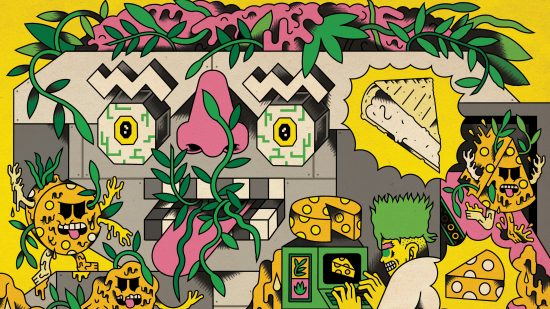

「おいしさ」をリバースエンジニアリング、AI考案の植物性チーズ

米国のクライマックス・フーズは、人工知能技術を使って、10万種類の植物成分の組み合わせからおいしいヴィーガン・チーズを開発した。既存のチーズと遜色ない滑らかさとリッチな味わいを実現している。

-

生成AI革命の次は「ロボット革命」 夢が近づく3つの理由

「チャットGPT」で生成AIが一気にブレークしたように、家庭用ロボットも実用化の時期が近づいているかもしれない。そう考えられる理由を3つ、説明しよう。

-

家庭用ロボットはいつ、 「知能」を手に入れるか?

家事の多くをこなせるロボットを作ることは、長らくロボット工学研究者の夢だった。生成AI技術が急速に進展する今、夢のロボットはいつ実現するか。

-

走るから歩くへ、強化学習AIで地道に進化する人型ロボット

二足歩行の人型ロボットはパルクールなどの派手なデモ動画が話題になることが多い。だが、実用化にはもっと基本的な動作を実行できる地道な進化が必要だ。

-

中国テック事情:AI人材争奪戦、トップ研究者はどこで働く?

世界トップクラスのAI専門家の4分の1以上が中国出身の研究者だ。かつては多くが米国に移動していたが、最新の分析では国にとどまる研究者が増えている。

-

EUのAI法は厳しい?緩い? 立法に関わったキーパーソン語る

-

撮れなかった写真がある—— 生成AIでよみがえる記憶

生成AIを用いた「シンセティック・メモリーズ(合成記憶)」プロジェクトは、世界中の家族がカメラに一度も収まることのなかった過去を取り戻す支援をしている。研究者と共同で、認知症の治療での応用も計画中だ。

-

誰もがオープンと言い出した ——AI業界で攻防、 オープンソースの定義を巡り

-

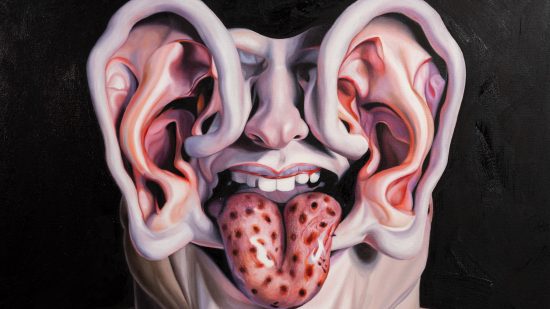

「AIアート」はアートか? オープンAI初の作家と、 創造性について語ったこと

生成AIモデルの新たな波が人間の創造性の未来に及ぼす意味とは何か。オープンAI初のアーティスト・イン・レジデンスである作家、アレックス・レーベンと語り合った。

-

AI生成テキストの透かし、改ざんは簡単 新研究で実証

AI生成テキストへの電子透かしの挿入は、誤情報や盗作を防ぐ上で重要な役割を果たしている。だが、新研究によって、その改ざんが驚くほど容易であることが明らかになった。

-

仕組みは不明でも製品化は過熱、生成AIブームの落とし穴

人工知能(AI)に関する理解は、まだ初期段階だ。AI搭載製品を販売する企業の宣伝に惑わされることなく、有用性は限られていることを肝に銘じる必要がある。

-

「Sora」登場で激震、 動画生成AIは映像制作の 未来をどう変えるか

-

生成AI「Sora」で作られた驚きの動画、制作者に聞く舞台裏

-

コンピューター科学者は 大規模言語モデルをなぜ 「科学」するのか?