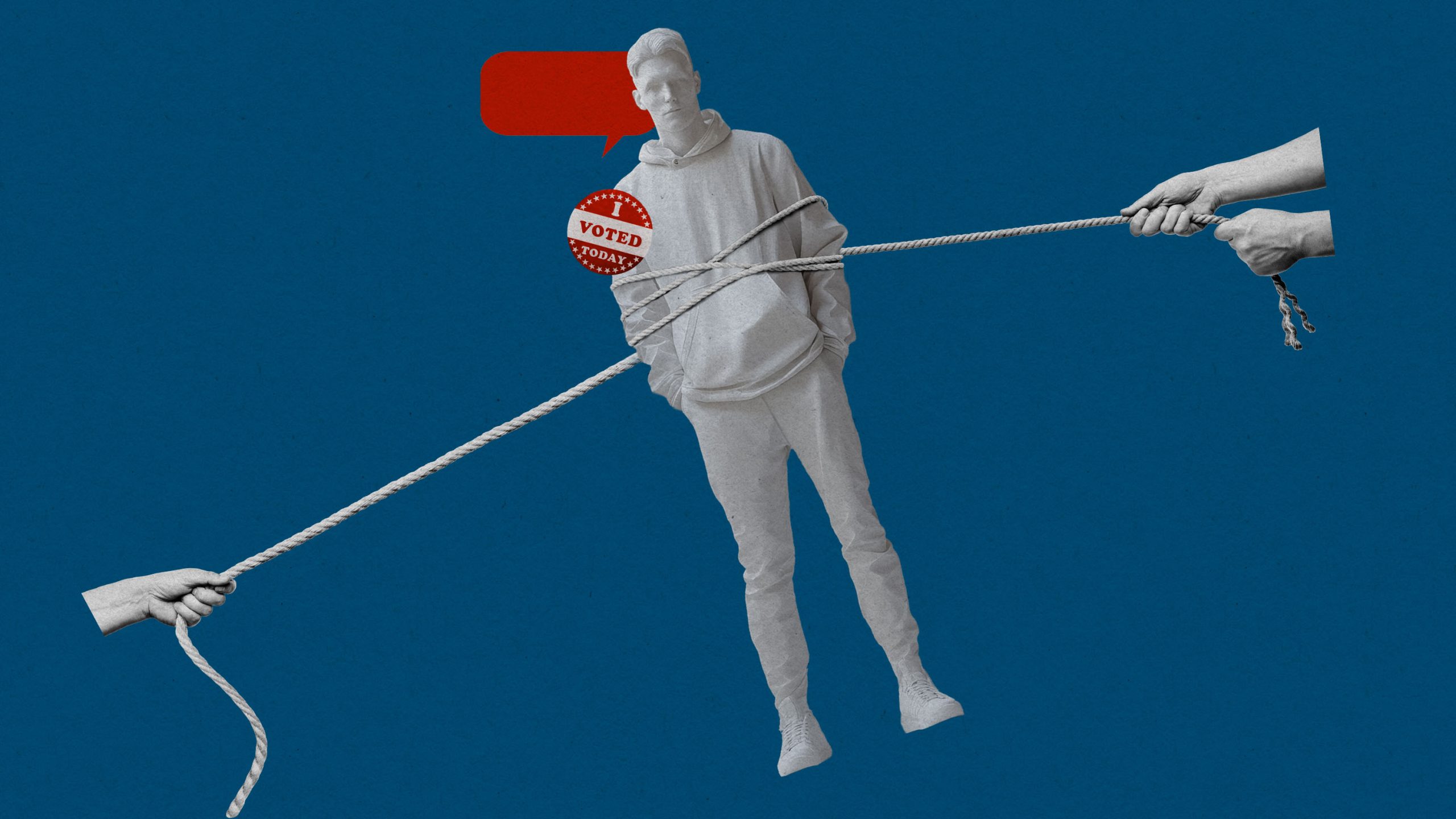

AIが有権者の意見を変えた

「事実と証拠」で説得力、

誤情報で世論形成のリスクも

AIチャットボットとの会話が有権者の政治的意見を変えることが、複数の最新研究で明らかになった。「事実と証拠」で語ると説得力が増すが、最も説得的なモデルほど虚偽も多く、誤情報による世論形成のリスクが民主主義を脅かす可能性がある。 by Michelle Kim2025.12.08

- この記事の3つのポイント

-

- AIチャットボットが一回の会話で有権者の政治的意見を変える効果が、政治広告の約4倍であることが判明した

- 党派的有権者は従来影響を受けないとされていたが、事実や証拠を用いるAIが説得力を持つことが確認された

- 最も説得力の高いモデルほど虚偽情報を多く含み,

- 民主主義への影響を監視する仕組みが必要とされる

2024年、米ペンシルベニア州の民主党下院議員候補シャメイン・ダニエルズは、アシュリー(Ashley)という名前の人工知能(AI)チャットボットを使って有権者に電話をかけ、続けて会話をした。「もしもし、私の名前はアシュリーです。シャメイン・ダニエルズの下院選挙運動のための人工知能ボランティアです」と電話は始まった。ダニエルズは最終的に勝利しなかった。しかし、これらの電話が彼女の活動に役立ったかもしれない。新たな研究により、AIチャットボットが1回の会話で有権者の意見を変えることができ、しかもそれが驚くほど効果的であることが明らかになったからだ。

複数の大学による研究チームは、政治的に偏向したAIモデルとの会話が、民主党員と共和党員のいずれにおいても、その人が対立する政党の大統領候補を支持する考えに向かわせるのに、政治広告よりも有効であることを発見した。チャットボットは事実と証拠を引用して考えを変えさせたが、それらは常に正確だったわけではない。実際、研究者らは、最も説得力のあるモデルが最も多くの虚偽を語っていたことを見出した。

学術誌『ネイチャー(Nature)』と『サイエンス(Science)』に掲載された一対の研究で詳述されたこれらの発見は、大規模言語モデル(LLM)の説得力を実証する新興研究分野の最新成果である。これらの研究は、生成AIにより、選挙の形がどのように変わる可能性があるかについて深刻な疑問を提起している。

「LLMとの1回の会話は、重要な選挙の選択に対してかなり意味のある効果をもたらします」。ネイチャー誌に掲載された研究に携わったコーネル大学の心理学者ゴードン・ペニークック准教授は述べる。「LLMは政治広告よりも効果的に人々を説得できます。なぜなら、リアルタイムではるかに多くの情報を生成し、会話の中で戦略的にそれを展開するからです」。

ネイチャー論文を執筆するため、研究チームは、2024年の米国大統領選挙の2カ月前、2300人以上の参加者を募集してチャットボットとの会話に参加させた。上位2候補のいずれかを支持するよう訓練されたチャットボットは驚くほど説得力があり、とりわけ、経済や医療などの問題に関する候補者の政策綱領について議論する際に効果的だった。カマラ・ハリス支持のAIモデルと会話したドナルド・トランプ支持者は、ハリス支持にわずかに傾くようになり、100点満点で3.9点ハリスの方向に動いた。これは2016年と2020年の選挙における政治広告の測定効果の約4倍だった。トランプ支持のAIモデルは …

- 人気の記事ランキング

-

- Is fake grass a bad idea? The AstroTurf wars are far from over. 「一番ましな悪い選択肢」 人工芝の安全性をめぐる 論争はまだ終わらない

- Will fusion power get cheap? Don’t count on it. 核融合は本当に安くなるのか? 楽観論に「待った」をかける新研究

- Digging for clues about the North Pole’s past 12万年前は無氷だった?海底22メートルの泥で掘り起こす北極点の謎

- Is carbon removal in trouble? 炭素除去業界に激震、最大顧客のマイクロソフトが購入を一時停止