ニューヨーク州のAI規制法案、「壊滅的リスク」に照準

ニューヨーク州議会のある議員が、高度なAIシステムに対する規制を目指す新法案を起草している。昨年、知事の拒否権発動で廃案になったカリフォルニア州の同様な法案のアイデアを踏襲しつつ、いくつかの変更を加えたものだ。 by Scott J Mulligan2025.01.16

- この記事の3つのポイント

-

- ニューヨーク州でAIモデルを規制する新法案RAISE法が提案された

- RAISE法は企業にAIモデルの安全計画策定と第三者監査を義務付ける

- RAISE法は最先端のAIモデルによる破滅的リスクの軽減に重点を置く

米国ニューヨーク州初となるコンピューター科学のバックグラウンドを持つ民主党議員は、廃案となったカリフォルニア州のAI安全法案(SB1047)の背後にあるアイデアを一部復活させ、最先端の人工知能(AI)モデルを規制する新バージョンをニューヨーク州で作りたいと考えている。これは、「責任あるAIの安全性と教育(Responsible AI Safety and Education) 」の頭文字をとってRAISE法と呼ばれている。

ニューヨーク州議会のアレックス・ボアーズ議員は、自身の法案がSB1047の成立を阻んだ懸念の多くに対処できると考えている。MIT テクノロジーレビューは草案を入手しているが、まだ公表はされておらず、中身が変更される可能性がある。

SB1047は当初、さしたる騒ぎもなく通過するであろう、かなり控えめな法案だと思われていた。実際、この法案はカリフォルニア州議会を大差で通過し、州民からも大きな支持を得ていた。

しかし、9月に署名のためにギャビン・ニューサム知事の机上に置かれる前に、この法案は全米で激しい論争を巻き起こした。グーグル、メタ、オープンAI(OpenAI)は、ナンシー・ペロシやゾーイ・ロフグレンといった民主党の大物連邦議員とともに、この法案に反対した。一方、ジェーン・フォンダやマーク・ハミルが法案への支持を表明するなど、ハリウッドの有名人までもが巻き込まれた。

結局、ニューサム知事はSB1047に拒否権を発動した。その結果、カリフォルニア州だけでなく、国家レベルの法律がないことから、いわゆるフロンティアAIモデルの規制は、最も強力なシステムが開発されている米国のどこにも事実上存在しないこととなった。

ボアーズ議員はいま、この戦いを復活させたいと考えている。RAISE法の主要条項には、AI企業にモデルの開発と展開に関する安全計画の策定を義務付けることが含まれている。

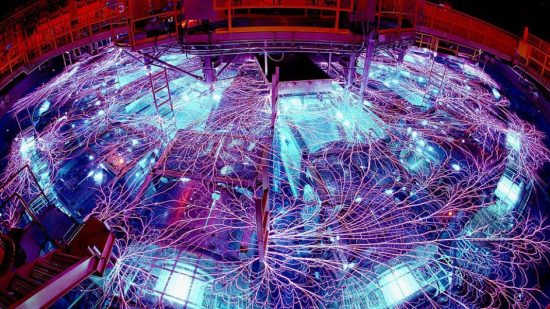

この法案はまた、AI企業の内部告発者に対する保護も定めている。AIモデルが「重大な危害」をもたらす可能性があると信じて情報を公開した従業員に対する報復を禁じると同時に、そのような内部告発者はニューヨーク州司法長官に情報を報告できるのだ。法案の定義する重大な危害のひとつとして、AIモデルを使用して化学兵器、生物兵器、放射能兵器、核兵器を製造し、その結果100人以上の死者または重傷者を出すケースが挙げられている。

あるいは、AIモデルの使用によって、人間による監視が制限された行為において100人以上の死者、または少なくとも10億ドルの損害が発生し、人間が犯したとすれば、故意、無謀、または重大な過失を伴う犯罪を構成するようなものを指す。

安全計画は、企業がモデルへの不正アクセスを防ぐためにサイバーセキュリティ保護を実施していることを保証するものになる。また、訓練前後のリスクを評価するためのモデルのテスト、さらには訓練後の修正に伴うリスクを評価するための手順の詳細な記述も要求される。たとえば、現在のAIシステムの中には、悪意ある行為者によって簡単かつ安価に除去できる安全対策しか備えていないものもある。安全計画では、そのような行為をどのように軽減するつもりなのかに触れなくてはならない。

そして、その安全計画は、現在AIモデルのテストをする、技術的専門知識を持つ非営利団体などの第三者による監査を受けることになる。違反が見つかった場合、この法案はニューヨーク州司法長官に罰金を科す権限を与え、必要であれば、危険な開発を中止させるかどうかを決定するために、裁判所に訴える権限を与えている。

法案の異なる趣旨

安全計画と外部監査はSB1047に組み込まれていた要素だが、ボアーズ議員はカリフォルニア州の法案とは違うものにする …

- 人気の記事ランキング

-

- Anthropic can now track the bizarre inner workings of a large language model 大規模言語モデルは内部で 何をやっているのか? 覗いて分かった奇妙な回路

- Promotion MITTR Emerging Technology Nite #32 Plus 中国AIをテーマに、MITTR「生成AI革命4」開催のご案内

- AI companions are the final stage of digital addiction, and lawmakers are taking aim SNS超える中毒性、「AIコンパニオン」に安全対策求める声

- What is vibe coding, exactly? バイブコーディングとは何か? AIに「委ねる」プログラミング新手法

- Tariffs are bad news for batteries トランプ関税で米電池産業に大打撃、主要部品の大半は中国製