AIが創る「もう1人の私」

リアルすぎる動画の

制作過程を本誌記者が体験

英国のユニコーン企業が提供する、最新の生成AI技術でアバター動画を作成するサービスを本誌記者が体験。記者が書いたニュースを読み上げてもらった。現実と区別がつかないほどのリアルな生成動画は、社会の混乱を招きかねない。 by Melissa Heikkilä2024.05.07

今後永遠に着ることになる服を決められず、私は遅刻しそうだった。

こう書くと、死期が近いように聞こえるかもしれないが、実際はその逆だった。人工知能(AI)映像スタートアップ企業のシンセシア(Synthesia)のおかげで、私は永遠の生を受けようとしていた。同社は過去数年間、AIを利用したアバターを制作してきたが、4月22日に生成AIの最新テクノロジーを活用した初の新世代AIアバターを発表した。これまで見たことのないほどリアルで表情豊かなアバターだ。今回のリリースで、誰でも自分のデジタルクローンを作れるようになったと言える。この新テクノロジーが公開される前の4月初旬の午後、同社が私のAIアバターを作ってくれることになった。

ロンドン東部にあるシンセシアのおしゃれなスタジオにどうにか到着できた私を、制作主任のトシン・オシンエミが出迎えてくれた。オシンエミはデータ収集プロセスで私を指導してくれることになっていた。ここで言う「データ収集」とは、私の顔の特徴やしぐさなどの情報を取り込むという意味だ。オシンエミは普段、俳優やシンセシアの顧客に対してこのデータ収集プロセスの指導をしている。

オシンエミは待機していたスタイリストとメイクアップ・アーティストを紹介してくれた。そして、私は準備に多くの時間を無駄にした自分を呪った。スタイリストとメイクアップ・アーティストは被写体の服装をチェックし、複数の撮影ショットが違和感なくつながるような、カメラ映えするものであることを確認する。スタイリストは私の服装は問題ないと言い(安堵)、メイクアップ・アーティストは私の産毛を整え、軽くメイクを直してくれた。メイク室には、過去に生成された人間のAIアバターの笑顔のポラロイド写真が何百枚も飾られていた。

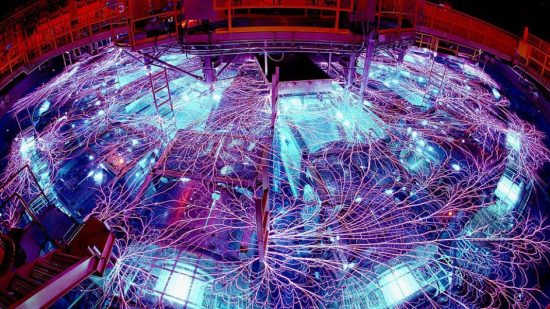

スタジオで生成されたデータを処理する小型スーパーコンピューターが廊下で機械音を立てていることを除けば、ディープフェイク製造工場というよりも、ニュース・スタジオに入るような感覚に近かった。

私は冗談で、MITテクノロジーレビューならオシンエミの仕事を未来の職種「ディープフェイク制作ディレクター」と呼ぶだろうと言ったら、オシンエミは「私たちは、『ディープフェイク』ではなく『合成メディア』という用語を好みます」と教えてくれた。

これは微妙な違いだが、意味的には大きな違いがあると主張する人もいるだろう。どちらの語も、必ずしも現実に起こったことではない行動や発言を見聞きできるAI生成映像または音声を意味する。しかし、「ディープフェイク」は評判が悪い。シンセシアのコーポレート・アフェアーズ&ポリシー責任者であるアレクサンドル・ヴォイカによると、この用語は約10年前に誕生して以来、非倫理的な意味合いをもつようになった。同意なしに制作された性的コンテンツや、デマやプロパガンダを広める政治キャンペーンなどが連想される。

「『合成メディア』は、より無害で生産的なバージョンです」とヴォイカは主張する。そしてシンセシアは、その最良バージョンを提供したいと考えている。

これまで、AIが生成した人物の映像には、ぎこちなさや不具合など、極めて容易に現実と区別できる何らかの不自然な要素が含まれていることが多かった。本物に非常に近いものの、本物と完全には一致していないため、そのような映像に人々は苛立ちや不安、不快感を感じることがある。この現象は一般に「不気味の谷」と呼ばれている。シンセシアは、同社の新テクノロジーを使えば不気味の谷から抜け出せるだろうと主張している。

生成AIの急速な進歩と人間の俳優によって作成された膨大な訓練データをAIモデルに送り込んできたおかげで、シンセシアは旧バージョンよりも実に人間らしく、表情豊かなアバターを作り出すことができた。生成されたAIアバターは、台本で伝えようとしている感情に対応し、イントネーションを合わせるのがうまくなった。たとえば、楽しい話をしているときはより陽気にふるまい、不快な話をしているときはより深刻に、あるいは悲しげにふるまうことができる。顔の表情を合わせるのもうまくなっている。つまり、言葉を発することなくわずかな顔の動きで気持ちを伝えることができるということだ。

しかし、この技術的進歩は、より大きな社会的・文化的変化の兆候でもある。私たちがスクリーンで目にするものの多くは、AIによって生成された(あるいは少なくとも小さな変更が加えられた)ものであり、何が本物であり、何がそうでないかを区別することがますます難しくなっている。このことは、私たちが目にするものすべてに対する信頼を脅かし、その結果、非常に現実的で、非常に危険な影響をもたらす可能性がある。

オックスフォード大学インターネット研究所(OII:Oxford Internet Institute)でAIの法的および倫理的影響を研究しているサンドラ・ワクター教授は、「簡単に真実を見出せる世界に別れを告げなければならないのかもしれません」と述べる。「ググるだけで何が事実で何がフィクションなのかすぐにわかるという考え方は、もう通用しないと思います」 。

だから、シンセシアが私のデジタルクローンを作ってくれることは楽しみだったが、「合成メディア」と「ディープフェイク」の区別は根本的に無意味なのではないかとも思った。たとえ前者が制作者の意図と被写体の同意を重視しているとしても、最終結果が同じであれば、AIアバターを安全に作る方法は本当にあるのだろうか? そして、真実を把握できなくなるとしたら、私たちは本当に「不気味の谷」から抜け出したいと思うのだろうか?

ともあれ、簡単に真実を見出せない時代の自分自身を眼にするのはどんな感じなのか、知るべき時が来た。

ほぼリアル

シンセシアのスタジオを訪れる1カ月前、私はオックスフォード・サーカス近くのオフィスに同社の最高経営責任者(CEO)であるビクター・リパーベリを訪ねた。リパーベリCEOによると、デンマーク育ちの彼が前衛的でマニアックなテクノ・ミュージックを探求した経験がシンセシア誕生の原点にあるという。インターネットのおかげで、彼は高価なシンセサイザーを買うことなく、ソフトウェアをダウンロードして自分の曲を制作できた。

「人々がそれぞれにできるやり方で自己表現するのを助けることは良いことだと心から思っています。それがより能力主義の世界をもたらすと思うからです」とリパーベリCEOは語る。彼は、深層学習を利用してある人の顔の表情をスクリーンに映し出された別の人物の顔の上に再現する研究を見つけたときに、映像でも同様のことができる可能性があると考えた。「深層学習ネットワークによって、リアルな外観と雰囲気を持つ映像フレームを生成できることが、この研究で初めて示されたのです」 。

その研究を主導したのは、ミュンヘン工科大学のマティアス・ニースナー教授だった。ニースナー教授は2017年にリパーベリCEOと共同でシンセシアを創業した。共同創業者には、リパーベリCEOが以前暗号通貨プロジェクトで協力したことがあったステフェン・ティエリルドとユニバーシティ・カレッジ・ロンドンのルルデス・アガピト教授も加わった。

シンセシアは当初、エンターテインメント業界向けにリップシンク(いわゆる「口パク」)および吹き替えツールを開発していた。だが、このテクノロジーの品質に対するハードルが非常に高く、あまり需要がないことがわかった。同社は2020年に方針を転換し、法人顧客向けに第1世代のAIアバターを発表した。この方針転換が功を奏した。2023年にシンセシアはユニコーン企業になった。つまり、評価額10億ドル超えを達成した数少ない欧州のAI企業となった。

第1世代のアバターは、動きをぎこちなく繰り返すだけでバリエーションに乏しいものだった。その後のバージョンではより人間らしく見えるようになったが、依然として複雑な語句を言うのに悪戦苦闘し、ややズレが生じていた。

ここで問題となるのは、人間が他人の顔を見ることに慣れているという事実だ。「私たち人間は、本物の人間の動きを知っています」とシンセシアの最高技術責任者(CTO)であるジョナサン・スタルクは指摘する。幼い頃から「人間は、人と顔に注意を向けています。何が正しいかわかっているので、正しくないものは極端に目についてしまうのです」 。

広義のディープフェイクなどの初期のAI生成映像は、「敵対的生成ネットワーク(GAN)」を使って作成された。GANとは、相互に作用する2つのニューラル・ネットワークを使って画像や映像を生成する従来手法のことである。手間のかかる複雑なプロセスであり、不安定なテクノロジーだった。

しかし、ここ1年ほどの生成AIブームで、シンセシアは生成系のニューラル・ネットワークを使用することで、より高品質のアバターを安定して作成できることを発見した。生成AIモデルに供給されるデータが多ければ多いほど、モデルは多くを学ぶことになる。シンセシアは、大規模言語モデルと拡散モデルをアバター生成に使った。前者はアバターが台本に対応するのを助け、後者は画像のピクセルを生成する。

品質が飛躍的に向上したにもかかわらず、シンセシアは依然としてエンターテインメント業界への進出を試みていない。同社は、ビジネス向けプラットフォームと自認し続けている。人々がユーチューブ(YouTube)やティッ …

- 人気の記事ランキング

-

- Anthropic can now track the bizarre inner workings of a large language model 大規模言語モデルは内部で 何をやっているのか? 覗いて分かった奇妙な回路

- Promotion MITTR Emerging Technology Nite #32 Plus 中国AIをテーマに、MITTR「生成AI革命4」開催のご案内

- AI companions are the final stage of digital addiction, and lawmakers are taking aim SNS超える中毒性、「AIコンパニオン」に安全対策求める声

- What is vibe coding, exactly? バイブコーディングとは何か? AIに「委ねる」プログラミング新手法

- Tariffs are bad news for batteries トランプ関税で米電池産業に大打撃、主要部品の大半は中国製