誰もがオープンと言い出した

——AI業界で攻防、

オープンソースの定義を巡り

メタやグーグルが自社のAIモデルを「オープンソースAI」として公開している一方で、それらが本当にオープンソースと言えるかどうかについては意見が分かれている。訓練に用いたデータを明らかにしていなかったり、ユースケースを制限したりしているからだ。 by Edd Gent2024.04.08

突如として「オープンソース」が人工知能(AI)業界で最新の流行語となった。メタ(Meta)はオープンソースの汎用AI(AGI)の開発を約束し、イーロン・マスクは、オープンAI(OpenAI)がオープンソースのAIモデルを提供していないとして同社を提訴した。

一方で、自分たちこそオープンソース擁護者だと主張するテック業界のリーダーや企業も増え続けている。

だが、根本的な問題がある。「オープンソースAI」の定義についての合意がないのだ。

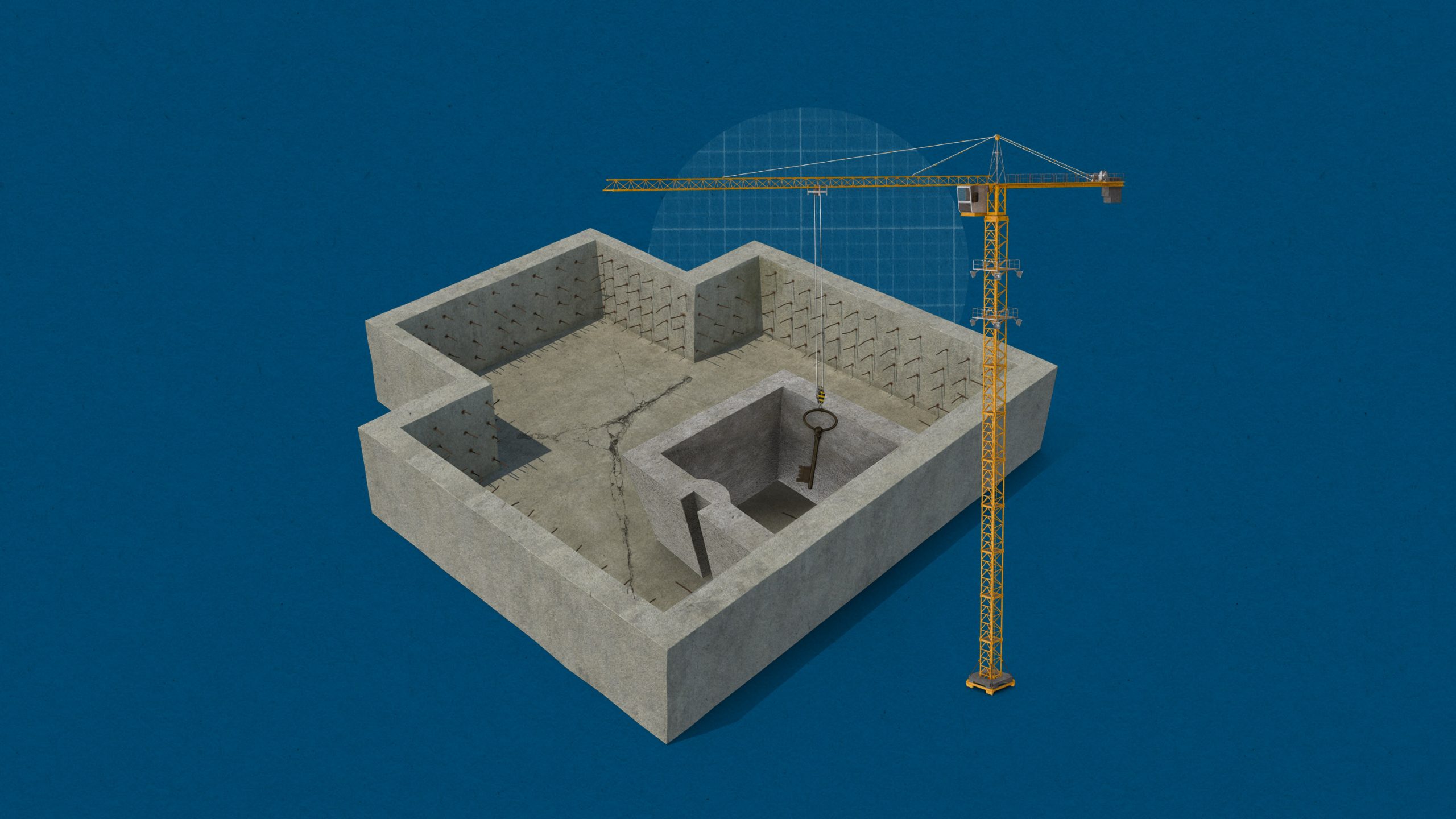

表面的には、オープンソースAIにより、誰もがAIテクノロジーの発展に参加できる未来が約束される。オープンソースAIはイノベーションを加速させ、透明性を高める。そして、間もなく私たちの生活の多くの側面に変革をもたらす可能性のあるAIシステムに対し、ユーザーの主導権を拡大する可能性がある。だが、それはそもそも何なのだろうか? AIモデルがオープンソースであるか否かは、何をもって言えるのだろうか?

その答えによっては、テクノロジーの将来に重大な影響を及ぼすかもしれない。テック業界が統一的な定義に落ち着かないうちは、有力企業はその概念をいとも容易く、自分たちの都合に合わせて曲解することが可能だ。そしてそれは、今日の有力企業の支配力を強化するための道具になりうる。

この論争に加わろうとしているのが、オープンソースの標準的な定義を決定する役割を自任する団体、オープンソース・イニシアティブ(OSI)である。1998年に創設されたこの非営利団体は、ソフトウェアがオープンソースであると見なせるかどうか判断する規則集として幅広く受け入れられている「オープンソースの定義」を管理している。

OSIは現在、研究者、弁護士、政策立案者、活動家、そしてメタやグーグル、アマゾンなど大手テック企業の代表者らから成る総勢70人のグループを結成し、オープンソースAIの実用的な定義を検討している。

しかし、オープンソース・コミュニティの参加者は、ハクティビストからフォーチュン500企業まで多岐にわたる。定義の大原則については幅広い合意ができているものの、問題は細部に宿る悪魔だということが明白になりつつある、とOSIのステファノ・マフッリ執行役員は言う。考慮すべき利害の対立が非常にたくさんあるため、全員を満足させつつ大企業の協調も得られる答えを見つけるのは、簡単な仕事ではない。

あいまいな基準

定義についての合意が存在しないため、オープンソースAIという用語は、テック企業によって安易に用いられている。

昨年7月、メタは自らがオープンソースとするモデル「ラマ(Llama) 2」を自由に利用できるようにした。同社は、過去にもいくつかのAIテクノロジーを公開している。「我々は、オープンソースAIを定義しようとするOSIの取り組みを支持しています。世界中のオープンソース・コミュニティの利益のために、今後もそのプロセスに参加し続ける所存です」と、メタのAI・オープンソース・ライセンシング担当副法務部長、ジョナサン・トレスは語る。

メタとは対照的なのが、ライバル企業のオープンAIである。オープンAIは何年も前から安全性の懸念を理由に、自社の主要モデルに関する詳細の公開を徐々に減らしてきた。「我々が強力なAIモデルをオープンソース化するのは、乱用やイノベーション加速などのリスクとメリットを慎重に比較検討してからです」と、広報担当者は述べている。

スタビリティAI(Stability AI)やアレフ・アルファ(Aleph Alpha)などの他の大手AI企業も、オープンソースと称するモデルを公開してきた。また、ハギング・フェイス(Hugging Face)は、自由に利用可能なAIモデルの大規模なライブラリを提供している。

グーグルは、自社モデルの中でも特に強力な「ジェミニ(Gemini)」や「パーム(PaLM 2)」などに関して、より閉鎖的なアプローチを取ってきた。しかし、2月にリリースされた「ジェマ(Gemma)」モデルは自由にアクセスすることができ、しかもLlama 2と比べても遜色のない能力を備えている。ただしグーグルはそれらのモデルを、「オープンソース」ではなく、「オープン」と表現している。

もっとも、こうしたモデルをすべて、本当にオープンソースと呼べるかどうかについては、大きな意見の相違がある。まず、Llama 2にもGemmaにもライセンスが付随し、ユーザーがそのモデルを使ってできることが制限されている。それは、オープンソースの原則にとって受け入れがたいことだ。「オープンソースの定義」で最も重要な条項の一つでは、ユースケースに関する制限を課すことを一切禁じている。

そのような条件が付与されないモデルに関しても、基準はあいまいだ。オープンソースの概念は、開発者が制限なくソフトウェアを使用・研究・改変・共有できるように意図されている。しかし、AIの研究は従来のソフトウェアとは根本的に異なる。ソフトウェアに当てはまる複数の重要な概念をAIにそのまま適用することはできないと、OSIのマフッリ執行役員は言う。

最大の障害の一つが、今日のAIモデルはおびただしい数の要素から構成されていることだ。ソフトウェアに手を加えるには、ソースコードさえあればよいと、マフッリ執行役員は言う。しかし、AIモデルに手を付けるには、その目的によって、訓練済みモデルとその訓練データ、そのデータの前処理に使用されるコード、訓練プロセスを統制するコード、モデルの基礎的なアーキテクチャ、あるいはその他諸々の細部にアクセスする必要が生じる可能性がある。

モデルの有意義な研究や改良のためにアクセスが必要な構成要素については、判断の分かれる余地がある。「どのような基本的な自由や権利が行使できるのが望ましいのかという点に関しては、合意が得られています」とマフッリ執行役員は言う。「それらの権利を行使する仕組みが不明確なのです」。

ソフトウェア開発者がオープンソースのメリットを享受したのと同様に、AIコミュニティがオープンソースAIの恩恵を受けるには、この議論に決着をつけることが不可欠になるとマフッリ執行役員は言う。オープンソースの概念は、用語の意味に関する幅広いコンセンサスの上に築かれたのだ。「業界の大多数に尊重され、採用される定義があることで、明確さが得られます」と、マフッリは言う。「この明確さが、コンプライアンスにかかるコストの抑制、摩擦の減少、共通の認識につながるのです」。

間違いなく最大 …

- 人気の記事ランキング

-

- What is vibe coding, exactly? バイブコーディングとは何か? AIに「委ねる」プログラミング新手法

- A Google Gemini model now has a “dial” to adjust how much it reasons 推論モデルは「考えすぎ」、グーグルがGeminiに調整機能

- Meet the researchers testing the “Armageddon” approach to asteroid defense 惑星防衛の最終戦略 科学者たちが探る 「核爆発」研究の舞台裏

- Anthropic can now track the bizarre inner workings of a large language model 大規模言語モデルは内部で 何をやっているのか? 覗いて分かった奇妙な回路