人工「超知能」暴走防止へ、

オープンAIが初成果を発表

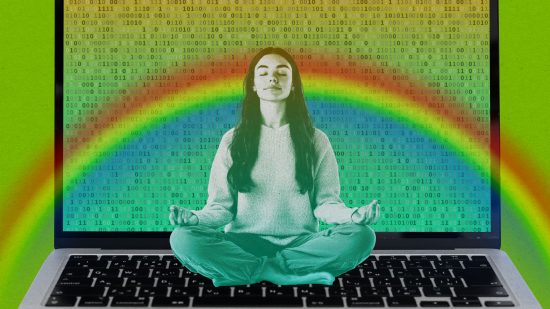

オープンAIは、「人工超知能」の暴走を防ぐために社内に組織したチームによる研究成果の第一弾を発表した。その手法は、比較的性能が劣る大規模言語モデルに、より強力な大規模言語モデルを監督させるというものだ。 by Will Douglas Heaven2023.12.15

オープンAI(OpenAI)は、「超知能」の暴走を防ぐため社内のイニシアチブとして設立された「スーパーアライメント・チーム」による最初の成果を発表した。同社の言う超知能とは、人間を上回る知能を持つようになる可能性がある、仮説上の未来のコンピューターのことである。

同社の多くの発表とは異なり、今回の成果は大きな画期的な躍進を告げるものではない。地味な研究論文の中で、スーパーアライメント・チームは、比較的性能が劣る大規模言語モデルに、より強力なモデルを監督させる技術について説明し、人間が人間よりも賢い機械を監督する方法を解明するための小さな一歩になるかもしれないと指摘している。

オープンAIの最高経営責任者(CEO)であるサム・アルトマンが、(主任科学者であるイリヤ・サツケバーが主導した社内クーデターの試みにより)取締役会から解任され、3日後に復職するという危機に見舞われてから1カ月も経っていないが、そのメッセージは明確だ。オープンAIは通常通りのビジネスに戻ったのだ。

しかし、オープンAIのビジネスは通常のビジネスとは異なる。多くの研究者は、機械が人間の知能を上回るようになるのかどころか、人間の知能に匹敵するようになるのかということに、いまだに疑問を抱いている。オープンAIのチームは、機械が最終的に優位に立つことは当然の成り行きだと考えている。「人工知能(AI)はここ数年、驚くほど急速に進歩しています」と、スーパーアライメント・チームの研究者であるレオポルド・アッシェンブレナーは話す。「我々はあらゆるベンチマークを更新し続けており、その進歩はとどまるところを知りません」。

アッシェンブレナーをはじめとする同社の社員たちは、人間のような能力を持つモデルの誕生はすぐそこまで来ていると考えている。「しかし、それだけでは終わりません」とアッシェンブレナーは言う。「超人的なモデル、人間よりもはるかに賢いモデルが登場することになります。そしてそれは、根本的な新しい技術的課題を提起することになるでしょう」。

7月、サツケバーと、同じくオープンAIの科学者であるヤン・ライクは、こうした課題に取り組むためにスーパーアライメント・チームを立ち上げた。「私は自分の利益のために取り組んでいるのです」と、サツケバーは9月にMITテクノロジーレビューに語った。「誰かが作った超知能が暴走しないということは、当然のことながら重要なのです。当たり前のことですが」。

AIの安全性に対するオープンAIの無責任なアプローチが理由でアルトマンCEO …

- 人気の記事ランキング

-

- What is vibe coding, exactly? バイブコーディングとは何か? AIに「委ねる」プログラミング新手法

- Anthropic can now track the bizarre inner workings of a large language model 大規模言語モデルは内部で 何をやっているのか? 覗いて分かった奇妙な回路

- Tariffs are bad news for batteries トランプ関税で米電池産業に大打撃、主要部品の大半は中国製

- Meet the researchers testing the “Armageddon” approach to asteroid defense 惑星防衛の最終戦略 科学者たちが探る 「核爆発」研究の舞台裏