「禁止は一切検討せず」イェール大副学長、生成AIへの対応語る

高等教育機関はチャットGPTなどのAI大規模言語モデルにどう向き合うべきか? 米国の名門大学であるイェール大学の副学長が考えを語った。 by Tate Ryan-Mosley2023.09.06

この記事は米国版ニュースレターを一部再編集したものです。

米国在住の多くの人にとって、9月こそが本当の意味での新年の始まりだ。花火や新年の抱負こそないものの、新しいノートに下ろし立てのスニーカー、荷物が詰まった車といった光景がそこにはある。新学期のスタートは何か新しいことが始まるように感じられるという意見には、私のように大学生活が遠い過去のものになってしまった人でも同意してくれるのではないだろうか。

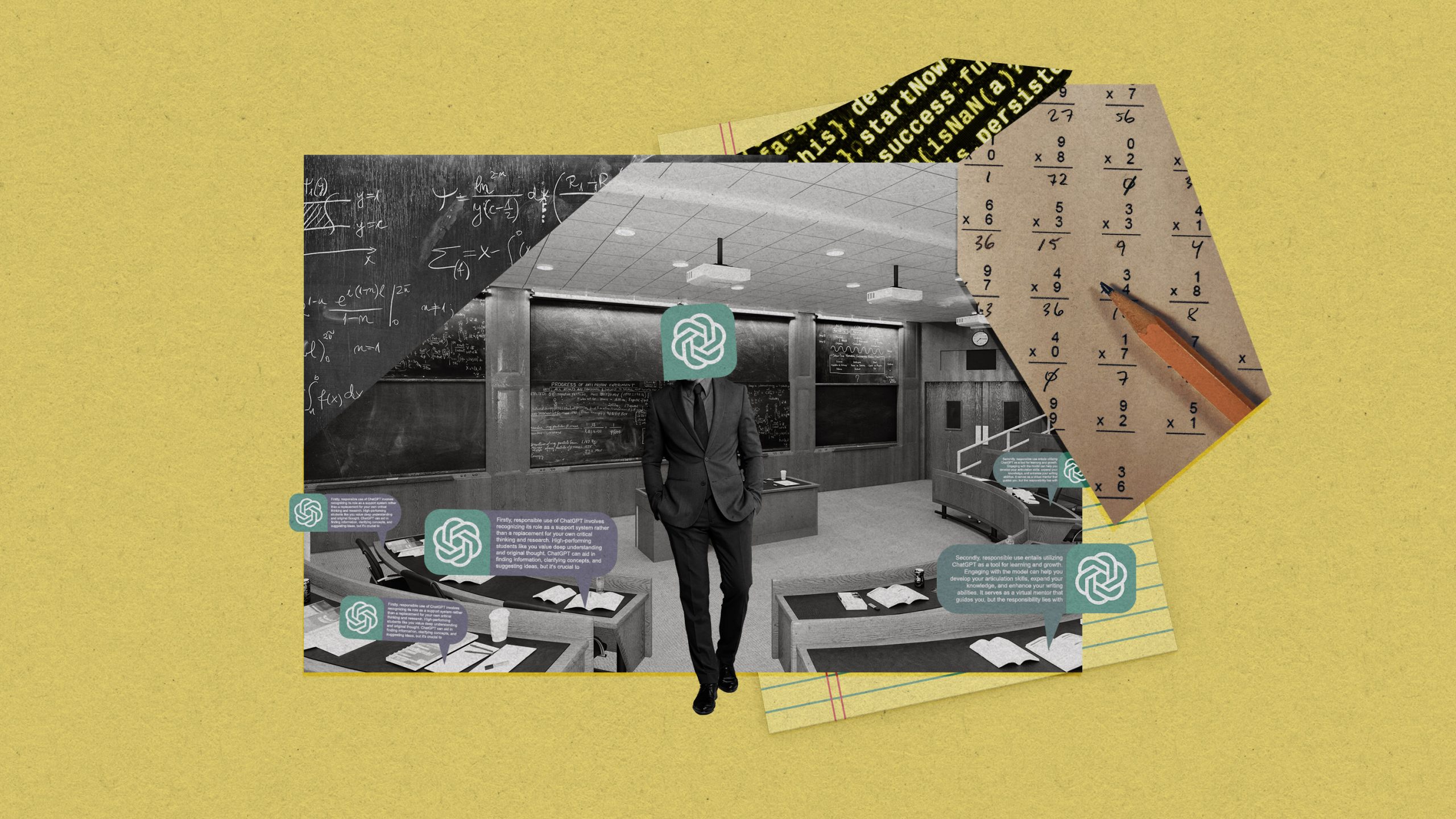

どうやら今年の大きな注目は、昨年末を特徴づけた話題と同じであるようだ。それはチャットGPT(ChatGPT)をはじめとする大規模言語モデルである。昨冬から春にかけては、学校における人工知能(AI)の利用について非常に多くの見出しが踊り、パニックに陥った一部の学校ではチャットGPTが完全に禁止される事態にまで至った。本誌のウィル・ダグラス・ヘブン編集者は、今はパニックになるような時ではない、という記事を書いた。生成AI(ジェネレーティブAI)は教育を変えるが、破壊することはないと論じたのだ。その後、この夏の数カ月間に考えを巡らせる時間を少しばかり得たことで、アプローチの方法を考え直した学校もあるようだ。

高等教育機関が学業においてこのテクノロジーにどのようなアプローチを採ろうとしているのか? その見通しを知るために、イェール大学のジェニー・フレデリック副学長に話を聞いた。フレデリック副学長は、教職員と学生に対するリソースを提供するプアヴ教育・学習センター(Poorvu Center for Teaching and Learning)の創設理事を務めており、イェール大学がチャットGPTへのアプローチを決めるにあたって中心的な役割を果たしている。

今回のインタビューでフレデリック副学長は、イェール大学がチャットGPTの禁止を検討したことはなく、むしろ連携を望んでいると語った。以下に、フレデリック副学長の話した内容の趣旨と、特に興味深かった点を紹介する。内容は、簡潔性、明確性を考慮して編集している。

◇

生成AIは新しいものですが、機械に何ができて何ができないのかを学生に学ばせることは、新しいことではありません。

教える側としては、自分は学生にこの課程で何を学んでほしいのかを、改めて考え直すことが非常に重要です。

もしロボットが何かを十分にこなせるのであれば、学生に何を学んでほしいのか、考え直す必要があるのでしょうか? あるいはなぜそれを知ることが重要なのか、という基準を引き上げる必要があるのでしょうか? たとえば、段落を構成すること、自分で調べることが何を意味するのか、学生たちにどうやって伝えていくのでしょうか? その取り組みから、学生たちは何を得るのでしょうか? 電卓を使えばできるのに、私たちは皆、割り算の筆算を学びます。その目的は何でしょうか?

プアヴセンターには教職員諮問委員会があり、グループのメンバーには微積分学の教授がいます。彼は笑ってこう言いました。「私としては、皆さんがこのことに取り組んでいる姿を目にするのはある種、愉快なことです。なぜなら私たち数学者は、機械が計算を実行できるという事実と向き合って来なければならなかったからです。ずっと昔、もう何十年前から電卓は使えたのですから」。

ですから私たちは、学生に何かを学ぶよう求める際に、それが機械が実行できることであれば、学習を正当化する理由を考えなければなりません。

学生に対してどんな使い方を認めるのか、規範的な方針を定めるのは時期尚早でしょう。

イェール大学がチャットGPTの禁止を検討したことは一瞬たりともありません。大学としての私たちの役割の中で、学習と実験が可能な環境づくりをどのように促していけるかについて考えました。 これは新たなテクノロジーですが、単なる技術的変化ではありません。社会として、私たちが人間をどのように考え、知識をどのように考え、学びについて、そしてそれが何を意味するのかについて考えることに挑むときなのです。

私は教職員を集めて、「私たちにはガイダンスが必要ですよね」と言いました。私たちが必ずしも答えを持っているわけではありませんが、教職員が参照できる厳選されたリソースは必要です。これを使わなければならない、これを使ってはいけない、これを使うための枠組みはこれだ、といった方針は設けていません。その課程にAIがどのように関係しているのか、どのように利用できるのか、あるいは使うべきではないのか、といったことを学生たちが理解できるようにする必要があります。

チャットGPTが不正に利用されることよりも、不正を招いた原因の方が重要です。

学生の不正について考えた場合、不正をすることを望む者は誰もいないでしょう。学生たちは大金を払って教育を受けているのですから。ですが、時間が足りなかったり、自分の能力を過信してしまったり、精神的に追い込まれてしまったりして、本当に難しくなってしまう、といったことは起こります。追い詰められて、残念な決断に至ってしまうのです。

ですから私としては、精神的健康(メンタルヘルス)や時間管理に影響を与える物事の方がはるかに大きな懸念事項です。できないけれど取り組まなければならない課題に直面した学生が追い込まれないように、私たちはどのように支援すればよいのでしょうか?

チャットGPTは新たな不正の手段をもたらしますが、人を不正に向かわせる過程はやはり同じだと思っています。ですからその過程と向き合っていきましょう。

学生たちはプライバシーを危険にさらしている可能性があります。

もっともなことですが、学生たちがシステムに情報を与えているのではないかとの若干の懸念があります。チャットGPTや競合のシステムを使うたびに、利用者はそのシステムを改善しています。オープンAI(OpenAI)やどこかの企業に労働力を提供することに対して、私たちは倫理上の疑問を抱えています。それらが正確にはどのように機能しているのか、入力した内容が長期にわたってどのように保存、管理、監視、監督されているのかを私たちは知りません。これは過度に陰謀論的な話をしようとしているわけではありません。学生にそうすることを求めるなら、私たちには学生の安全、プライバシーに対する責任があります。イェール大学が厳しいデータ管理ポリシーを定めているのには、しっかりした理由があるのです。

教師は学生に助言を求めるべきです。

一般に、学生たちは教職員のはるか先を行っています。彼らは新たなテクノロジーが現れては消えていく世界で育ち、色々なことを試しています。もちろんチャットGPTはその最新のものであり、彼らはそれを使っています。彼らは責任を持ってそれを使いたいと思っています。学生たちは「何が認められているのですか。私にはこんなことができますよ。これは許されますか?」と聞いてきます。

ですから私は教職員に、自分で試してみるべきだと助言しました。少なくとも学生たちに何が可能なのかを熟知し、自分が出す課題について、このツールで何が可能になるのかを考える必要があります。チャットGPTの使用が認められるか否かについて、どんな方針やガイダンスを学生に与えるのでしょうか。どんな方法であれば使用が認められるのでしょうか。

教師が一人でする必要はありません。学生たちと対話することができます。共同で何かを作り出せますし、その経験を授業に活用してはどうでしょうか。

あなたが教育する側の人間であれば、今や世界にはAIがあることを認識するべきだと私は心から思います。学生たちは、AIが各産業にさまざまな形で組み込まれていく世界に備える必要があります。私たちは、学生に準備をさせる必要があるのです。

◆

テック政策関連の気になるニュース

- アルバニアの小さな町の住民が、ティックトック(TikTok)のアルゴリズムに促されて英国に移住したというこのエコノミスト(Economist)誌の驚きの記事は、数日にわたって私の頭から離れなかった。レコメンド・アルゴリズムが人々の行動に与える影響は、長きにわたって私の個人的な(そして、 プロとしても)強い関心事だが、この話は本当に劇的な一例を示している。

- 米上院多数党院内総務のチャック・シューマーは、AIに関する議会討論の招待者リストを発表した。私はこの件について、シューマー議員が6月に最初にリストを発表した際に取り上げている。招待者はテック企業の最高経営責任者(CEO)の比率が非常に大きくなっているが、米労働総同盟・産業別組合会議(AFL‐CIO)議長のリズ・シューラー、AI倫理研究者のデブ・ラジも名を連ねている。この顔ぶれについて、一部の人々からはすぐに批判の声が上がった。その理由のひとつは、AI政策について情報提供を目的に招待を受けた人々の中に、AIから利益を得る立場にある幹部が多すぎるというものだった。

- ソーシャルメディアの凋落とグループチャットの台頭についてのインサイダー(Insider)誌の記事を私はとても気に入った。おそらくそれは、記事が私自身の行動を反映した内容であり、いつだって私は自分の習慣が私ひとりだけのものではないと感じられることが好きだからだろう。

テック政策関連の注目研究

レコメンド・システムと言えば、スタンフォード大学の新たな研究により、ユーチューブ(YouTube)のアルゴリズムは過激主義者のコンテンツという底なし沼に多くの人々を送り込んではいないが、「オルタナティブや過激主義者のチャンネルが熱心な視聴者の目に触れやすくなるという点で、依然として重要な役割を果たしている」ことが明らかになった。ユーチューブは過去に、過激なコンテンツを比較的ナイーブな視聴者に提示しているという大きな問題を抱えていることが報告されていた(同社はこれを否定している)。

アトランティック(Atlantic)誌でこの研究についての記事を書いたケイトリン・ティファニーは、2019年にユーチューブがデマの減少やヘイトスピーチの非収益化を目的として実施したレコメンド・システムの変更が、先鋭化問題の改善に役立ったのではないかと指摘している(しかし当然ながら、すでにそういったものに触れてしまった人々が過激なコンテンツの視聴サイクルにはまり込んでいることは依然として問題である)。

- 人気の記事ランキング

-

- A Google Gemini model now has a “dial” to adjust how much it reasons 推論モデルは「考えすぎ」、グーグルがGeminiに調整機能

- What is vibe coding, exactly? バイブコーディングとは何か? AIに「委ねる」プログラミング新手法

- Meet the researchers testing the “Armageddon” approach to asteroid defense 惑星防衛の最終戦略 科学者たちが探る 「核爆発」研究の舞台裏

- Anthropic can now track the bizarre inner workings of a large language model 大規模言語モデルは内部で 何をやっているのか? 覗いて分かった奇妙な回路

- テイト・ライアン・モズリー [Tate Ryan-Mosley]米国版 テック政策担当上級記者

- 新しいテクノロジーが政治機構、人権、世界の民主主義国家の健全性に与える影響について取材するほか、ポッドキャストやデータ・ジャーナリズムのプロジェクトにも多く参加している。記者になる以前は、MITテクノロジーレビューの研究員としてニュース・ルームで特別調査プロジェクトを担当した。 前職は大企業の新興技術戦略に関するコンサルタント。2012年には、ケロッグ国際問題研究所のフェローとして、紛争と戦後復興を専門に研究していた。