「人類滅亡」よりも心配すべき、生成AIの真のリスク

6月上旬に開催された世界最大のデジタル権利会議「ライツコン」では、人工知能(AI)のリスクについて多く語られた。参加者たちは、将来の人類滅亡の可能性よりも、今ここにある害にもっと目を向けて欲しいと考えている。 by Tate Ryan-Mosley2023.06.23

この記事は米国版ニュースレターを一部再編集したものです。

6月5日から8日かけて開催された世界最大のデジタル権利カンファレンス「ライツコン(RightsCon)」の一連のセッションに、私は療養しながら注目していた。ライツコンはここ何年かはバーチャル会議のみだったが、今回は再び、インターネット関連トップの倫理学者、活動家、政策立案者らがコスタリカまで実地に赴く形で開催されたのだ。

当然のことながら誰もが人工知能(AI)や、最近の大規模言語モデルの導入ラッシュについて話していた。カンファレンスの前に、まず国連が声明を発表し、ライツコンの参加者たちにAIの監視と透明性に焦点を当てるよう促した。

だが私が驚いたのは、ライツコンでの生成AI(ジェネレーティブAI)のリスクに関する会話が、私がニュースで読んできたシリコンバレーの大物たちが声高に発する警告とはまったく異なっていたことだ。ここ数週間ずっと、オープンAI(OpenAI)の最高経営責任者(CEO)であるサム・アルトマン、元グーグル研究員のジェフリー・ヒントン、AIのトップ研究者であるヨシュア・ベンジオ、イーロン・マスク、その他多くのテック関連の著名人たちが、AIが人類にもたらす「(絶滅までをも含む)存続のリスク」に対処するための規制と緊急行動を呼びかけてきた。

確かに、リスク評価や訓練データやプロセスに関する開示もなく、テクノロジーの悪用にもそれほど注意が払われていないように見える大規模言語モデルの急速な導入には懸念がある。だが、ライツコンのいくつかのセッションで講演者たちは、今のAIゴールドラッシュともいえるものは企業による利益追求の産物であり、必ずしも規制の不備やテクノロジー的に不可避な必然のせいではないと繰り返した。

まず最初のセッションでは、ワイアード(Wired)編集長の(そしてMITテクノロジーレビューの前編集長でもある)ギデオン・リッチフィールドとデジタル・フューチャーズ・ラボ(Digital Futures Lab)創業者のウルバシ・アネジャが、グーグルの最高法務責任者を務めるケント・ウォーカーと互角に渡り合った。「マイクロソフトのサティア・ナデラは、グーグルを躍らせたいと言ったのです。そしてグーグルは踊りました」とリッチフィールド編集長は語った。「この2社が市場で互いを負かそうとしているがために、私たち全員が今、鼻をつまんで虚空の中へジャンプしようとしているのです」。これに対してウォーカーは、AIの進歩が創薬のような分野にもたらし得る社会的利益を強調し、人権に対するグーグルの取り組みを改めて述べた。

翌日には、AI研究者のティムニット・ゲブルが、「AIがもたらす存亡の機」という議論に対して単刀直入に切り込んだ。「ツールを行為の主体者とするのは間違いであり、それは陽動作戦です。そして、そんな話をするのは誰かと見れば、それは外でもない、まさにこれらの企業に何十億ドルもつぎ込んできた人々です」とゲブルは言い放った。「つい数カ月前、ジェフリー・ヒントンは『GPT-4』は世界の蝶だと言っていました。 確かにGPT-4は、データを芋虫のように取って食べ、美しい蝶として世界に羽ばたきます。そして今になって突然、GPT-4は人類滅亡のリスクになっています。なぜ人々はこうした人々の言うことを真剣に受け止めているのでしょうか」。

AIをめぐる言説に不満を抱いている人権団体、ヒューマン・ライツ・ウォッチ(Human Right Watch)のテクノロジー・人権担当理事のフレデリケ・カルテウナーのような専門家たちは、今後起こるかも知れないことを推測するよりも、AIに関してすでにわかっているリスクに着実に向き合うようにすべきだと提案する。

実際、AIの使用によってもたらされる、明確かつ十分に記録されてきた害がある。以下のようなものだ。

・誤情報の増加と増幅

インスタグラム、ツイッター、ユーチューブなどのソーシャルメディア・プラットフォームのレコメンド・アルゴリズムは、正確であるかどうかにはお構いなく、極端で感情に訴えかけるようなコンテンツを優先することが明らかになっている。大規模言語モデルも、「幻覚(hallucination)」として知られる説得力のある誤情報を作り出すことでこうした問題をもたらしている(詳しくは後述)。

・偏った学習データとアウトプット

AIモデルは偏ったデータセットで訓練される傾向があり、それが偏ったアウトプットを導き出すことにもなる。そのことは、生活保護不正受給を犯すリスクスコアの割り当ての際に人々を差別するアルゴリズムや、白人男性よりも肌の黒い女性のほうが精度が低いことで知られる顔認証システムのように、既存の社会的不平等を強化してしまうことにもつながる。また、チャットGPT(ChatGPT)が人種差別的なコンテンツを吐き出した例も記録されている。

・ユーザーのプライバシーの侵害

AIモデルの訓練には大量のデータを必要とし、それらはWeb上で搔き集めたり購入されたりすることが多く、同意の有無やプライバシーの問題が発生する。チャットGPTやバード(Bard)のような大規模言語モデルを開発した企業は、訓練に使用したデータセットに関する情報をまだあまり公開していないが、インターネットからのデータが多く含まれていることは確かだ。

カルテウナーは、生成AIのチャットボットがメンタルヘルス治療といったリスクの大きな場で導入されることを特に懸念していると言う。「私は生成AIが、その用途で設計されたのではないものに対して、あるいはその目的に合っていないものに対して、全く見境なく使われることを心配しています」。

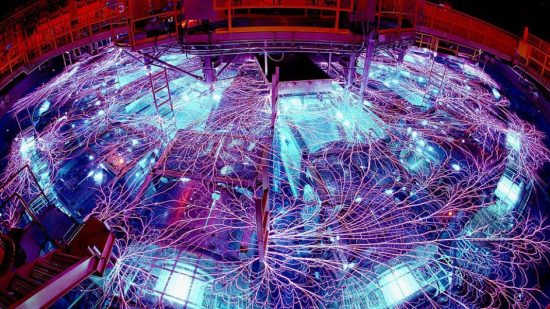

一方でゲブルは、最先端の大規模言語モデルを動かすために必要な大量のコンピューティング・パワーから生じる環境への影響について、改めて懸念を表明した(ゲブルは、グーグルの社内研究でこうしたことをはじめとするいくつかの懸念事項を問題にしたために、会社を解雇されたと主張している)。低賃金で働くチャットGPTのモデレーターたちも、モデルのアウトプットの有害性を弱めようと取り組む中で、心的外傷後ストレス障害(PTSD)を経験しているとゲブルは指摘する。

人類の未来に関する懸念について、カルテウナーは次のように問いかける。「いったい誰が滅亡するのですか。全人類が滅亡するのですか。歴史的に疎外されてきた人たちが現在、害されているのを、すでに私たちは目の当たりにしているではありませんか。それを考えると、人類滅亡などという言葉を私は冷ややかに捉えてしまうのです」。

◆

テック政策関連の気になるニュース

ブルームバーグが報じたマイクロソフトの発表によると、米国政府機関がGPT-4を導入しつつあるという。オープンAIは自社のチャットボットへの規制を望んでいるかもしれないが、その一方で、米国政府に売り込みたいとも考えている。

チャットGPTの「幻覚」問題は修正が不可能かもしれない。マサチューセッツ工科大学(MIT)の研究チームによると、ワシントンポスト紙が非常に役立つ記事の中で分析してるように、大規模言語モデルは互いに議論させるとより正確度が上がるが、事実の正確度はその能力には組み込まれていないのだという。「幻覚」が修正不可能であるならば、チャットGPTのようなツールを信頼して使えるのは限られた状況だけなのかも知れない。

ウォール・ストリート・ジャーナル紙、スタンフォード大学、マサチューセッツ大学アマースト校の調査によると、インスタグラムは、児童性的虐待コンテンツを投稿するアカウントの大規模なネットワークをホストしていた。インスタグラムは、この問題を調査する特別委員会を結成することで対応した。これほど重大な問題が、同プラットフォームのコンテンツ・モデレーターや自動モデレーション・アルゴリズムに気づかれないようなことがあり得るとは、非常にショッキングなことだ。

テック政策関連の注目研究

韓国を拠点とする人権団体「PSCORE (People for Successful Corean REunification :朝鮮半島の統一成功を目指す人々)」の新たな報告書が、北朝鮮でインターネットにアクセスするために必要な何日もかかる申請手続きについて詳しく説明している。金正恩につながる数十家族だけが制限なくインターネットにアクセスでき、「数千人」の政府職員、研究者、学生たちだけが厳しい監視下に置かれたバージョンにアクセスすることができる。マット・バージェスがワイアードで記事にしているように、ロシアと中国が、高度に制御されたWebインフラを北朝鮮に供給しているようだ。

- 人気の記事ランキング

-

- What is vibe coding, exactly? バイブコーディングとは何か? AIに「委ねる」プログラミング新手法

- Anthropic can now track the bizarre inner workings of a large language model 大規模言語モデルは内部で 何をやっているのか? 覗いて分かった奇妙な回路

- Tariffs are bad news for batteries トランプ関税で米電池産業に大打撃、主要部品の大半は中国製

- Meet the researchers testing the “Armageddon” approach to asteroid defense 惑星防衛の最終戦略 科学者たちが探る 「核爆発」研究の舞台裏

- テイト・ライアン・モズリー [Tate Ryan-Mosley]米国版 テック政策担当上級記者

- 新しいテクノロジーが政治機構、人権、世界の民主主義国家の健全性に与える影響について取材するほか、ポッドキャストやデータ・ジャーナリズムのプロジェクトにも多く参加している。記者になる以前は、MITテクノロジーレビューの研究員としてニュース・ルームで特別調査プロジェクトを担当した。 前職は大企業の新興技術戦略に関するコンサルタント。2012年には、ケロッグ国際問題研究所のフェローとして、紛争と戦後復興を専門に研究していた。