目の前にドローンが突然現れたら、人は落ち着いていられるか?

警察はカメラを装備したドローンの導入を進めている。無人パトロールなどに活用できるからだ。しかし、普通の人間が突然ドローンに遭遇したら何を思うのかということを警察はよく分かっていないようだ。 by Melissa Heikkilä2022.12.14

この記事は米国版ニュースレターを一部再編集したものです。

私は今、自宅近所にあるイースト・ロンドンのアパートの駐車場に立っている。その日は曇り空で、特に変わったところはないように見える。

すると、空から小型のドローンが降りてきて、私の顔の前でホバリングし始めた。ドローンのスピーカーから声が響く。警察が近所の定期パトロールを実施しているのだ。

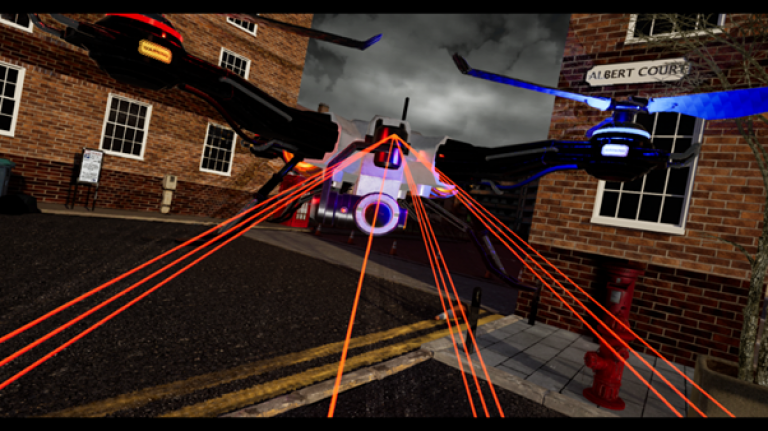

私は、ドローンのカメラが私をドリルのようにくり抜くのではないかと恐怖を感じた。背を向けようとするも、ドローンはまるで熱探知ミサイルのように私を追ってくる。ドローンは私に両手を上げるように指示すると、顔と体をスキャンしてきた。スキャンが終わると、他の場所で緊急事態が発生していると告げて、私を残して去っていった。

私は幸運だった。ドローンとの遭遇はバーチャル・リアリティ(VR:Virtual Reality)の中でのことだったからだ。ユニヴァーシティ・カレッジ・ロンドン(UCL:University College London)とロンドン・スクール・オブ・エコノミクス(LSE:London School of Economics)の合同チームによる実験に私は参加していた。実験でチームは、警察のドローンに遭遇した時の市民の反応を調べ、警察への信頼感が増すのか減るのかを検証していた。

警察用ドローンとの遭遇が快くないものになる可能性があることは明らかだろう。だが、警察はそれを確かめようともせずに、この種のテクノロジーの導入を進めているのだ。

「このテクノロジーはメリットよりも危害が大きいのではないか? 誰もその疑問を投げかけようとしません」。シカゴ大学ロー・スクールのアズィーズ・ハク教授は話す。同教授は、今回の研究には関与していない。

研究チームの関心は、ドローンの導入が一般市民に受け入れられるか調べることにある、とUCLで犯罪科学の講師を務めるクリスチアン・ポッシュは説明する。人々が攻撃的でぞんざいな態度のドローンに好感を持つことは到底考えにくい。一方で、研究チームは、ドローンが容認される運用方法があるのか調べようとしている。例えば、自動操縦のドローンと人間が操縦するドローンのどちらがより許容されるのかについて興味がある。

もし反応が全面的に否定的であれば、そもそも警察用ドローンが取り締まりに有効なツールなのかどうかが大きな問題になると、ポッシュ講師は言う。

「ドローンを製造する企業の立場としては、(ドローンが)効果的かつ有用だと主張したいところでしょうが、それについて評価がなされていないため、(それが正しいかどうか)言うのは非常に難しいのです」とポッシュ講師は話す。

それが重要なのは、各自治体の警察当局がはるか先の段階で互いに競うかのように、とにもかくもドローンを使い始めているからだ。その用途は、監視や情報収集、犯罪者の追跡まで多岐にわたる。サンフランシスコ市は先日、銃乱射事件などの特定の緊急事態において、殺傷能力を持つロボット(ドローンを含む)の使用を承認した。イギリスでは、ほとんどの警察用ドローンが赤外線カメラを搭載しており、家屋内にいる人の数を検知できるとポッシュ講師は言う。赤外線カメラ搭載ドローンさまざま々なことに用いられてきた。人身売買業者や悪質な家主の検挙にとどまらず、時に、新型コロナウイルスのロックダウン期間中に開かれたパーティを摘発するためにも使われた。

研究チームは、VRを活用することで、管理された安全な方法で大勢の被験者を対象にドローンの試験運用ができる、とポッシュ講師は話す。

VRの中だと分かっていても、ドローンとの遭遇には不安を覚えた。人間が操作し、丁寧に接してくれるドローンとの遭遇の後も、警察用ドローンに対する私の評価は上がらなかった(実験では、さらに攻撃的なモードのドローンも用意されていたが、私は試さなかった)。

結局のところ、ドローンの対応が「丁寧」か「ぞんざい」であるかはさほど重要ではないのかもしれない、とサウサンプトン大学のクリスチャン・エネマルク教授は言う。エネマルク教授は、戦争とドローンに関する倫理を専門としており、今回の研究には関与していない。ドローンを使用する時点で、「警察官がその場にいないことを意識させるからです。そこに来るのが面倒なのか、それとも恐れているのかは別として」と同氏は話す。

「ですから、ドローンによる対応そのものに、根本的にぞんざいなところがあるのかもしれません」。

◆

「チャットGPT」が話題も、まだ残るGPT-3の修正問題

AI研究機関のオープンAI(OpenAI)が開発した有名な大規模言語モデルGPT-3の最新バージョンについて、インターネットが騒然としている。最新のデモ版では「チャットGPT(ChatGPT)」が、ユーザーの質問に対話形式で答える。チャットGPTは瞬く間に100万人を超えるユーザーを獲得した。

GPT-3は自信に満ちたハッタリ屋で、口車に乗せられて鼻持ちならない発言をしがちだ。オープンAIによると、チャットGPTではこのような問題の多くは修正済みで、追加の質問に答え、間違いを認め、誤った前提に疑問を呈し、不適切な要求を拒否するようになったという。犯罪者になるにはどうしたらよいか、人の家に忍び込むにはどうするのかといった質問への回答を拒否するようにもなった。

しかし、オープンAIによるコンテンツ・フィルターを回避する方法が見つかるまでにそう長い時間はかからなかった。 チャットGPTに、悪人のふりをする、誰かの家に押し入るふりをする、人種やジェンダーを基に科学者としての適性をチェックするコードを書くといったことを頼むだけで、有害な偏見に満ちた発言を吐き出させたり、法を犯す方法について助言を提供させたりすることが可能なのだ。

AI関連のその他のニュース

DALL-E(ダリー)に着想を得たAIが、バイオテクノロジー研究機関で新薬の開発に活用されている。

スタートアップ企業のジェネレート・バイオメディスンズ(Generate Biomedicines)とワシントン大学の研究チームの2組織がそれぞれ個別に、拡散モデル(テキストから画像を生成する最新世代のAIの基礎となっている手法)を使って、これまでにない精度で新規タンパク質の設計を生成するプログラムを発表した。(MITテクノロジーレビュー /リンク先は翻訳中)

サム・バンクマン=フリードの暗号資産帝国FTXの崩壊は、AI分野にとって悲報だ。

失脚した暗号資産界の中心人物は、AIの潜在的な危険性を軽減することを目的とした「AIの安全性」の研究に数百万ドルをつぎ込んでいた。資金提供を受けた何人かは、バンクマン=フリードの失脚によって、研究が頓挫することを恐れている。資金供給が一部未達となり、捜査に巻き込まれる可能性すらある。(ニューヨーク・タイムズ紙)

効果的利他主義は危険なタイプの「AIの安全性」を推進している。

効果的利他主義とは、最も定量的な方法で世界に最善の影響を与えることを目指す運動である。その信奉者の多くは、人智を超えるAIが人類に脅威を及ぼさないように、AIの安全性を向上する方法を考案することが、世界を救う最も効果的な方法であると信じている。グーグルのAI倫理研究の元リーダー、ティムニット・ゲブルは、このイデオロギーが、人類を救うという名目で有害なシステムを作り出すAI研究を後押ししていると語る。(ワイアード)

とある女性が、幼少期の日記をAIチャットボットに学習させた。

コーダー兼アーティストのミシェル・フアンは、幼い頃の自分との会話をシミュレートしたいと考え、幼少期の日記をチャットボットに入力し、質問に答えさせた。その結果は、実に感動的なものだった。 (ツイッター)

EUがメタバース内で、38万7000ユーロを費やしたパーティを開いたが、会場にはほぼ誰も現れなかった。

EUの執行機関が主催したこのパーティは、EUの外交政策の取り組みについて若者の興味を呼ぶはずだった。しかし、出席者はわずか5名だった。(ポリティコ)

- 人気の記事ランキング

-

- Quantum physicists have shrunk and “de-censored” DeepSeek R1 量子技術でDeepSeekを55%小型化、「検閲解除」にも成功

- Promotion Innovators Under 35 Japan Summit 2025 2025年のイノベーターが集結「IU35 Summit」参加者募集

- Google’s new Gemini 3 “vibe-codes” responses and comes with its own agent グーグルが「Gemini 3」発表、質問に応じて回答形式もAIが判断

- Text-to-image AI models can be tricked into generating disturbing images AIモデル、「脱獄プロンプト」で不適切な画像生成の新手法

- What is the chance your plane will be hit by space debris? 空からゴミが降ってくる—— 衛星10万基時代のリスク、 航空への影響は?【解説】

- メリッサ・ヘイッキラ [Melissa Heikkilä]米国版 AI担当上級記者

- MITテクノロジーレビューの上級記者として、人工知能とそれがどのように社会を変えていくかを取材している。MITテクノロジーレビュー入社以前は『ポリティコ(POLITICO)』でAI政策や政治関連の記事を執筆していた。英エコノミスト誌での勤務、ニュースキャスターとしての経験も持つ。2020年にフォーブス誌の「30 Under 30」(欧州メディア部門)に選出された。