AIは人種差別を強化するのか? それとも排除するのか?

テクノロジーの公平性が、人間のそれを上回ることが可能なのだろうか。米国で根強い住宅ローンにおける人種差別の問題を例に、3人の専門家が議論した。 by Charlton McIlwain2020.11.21

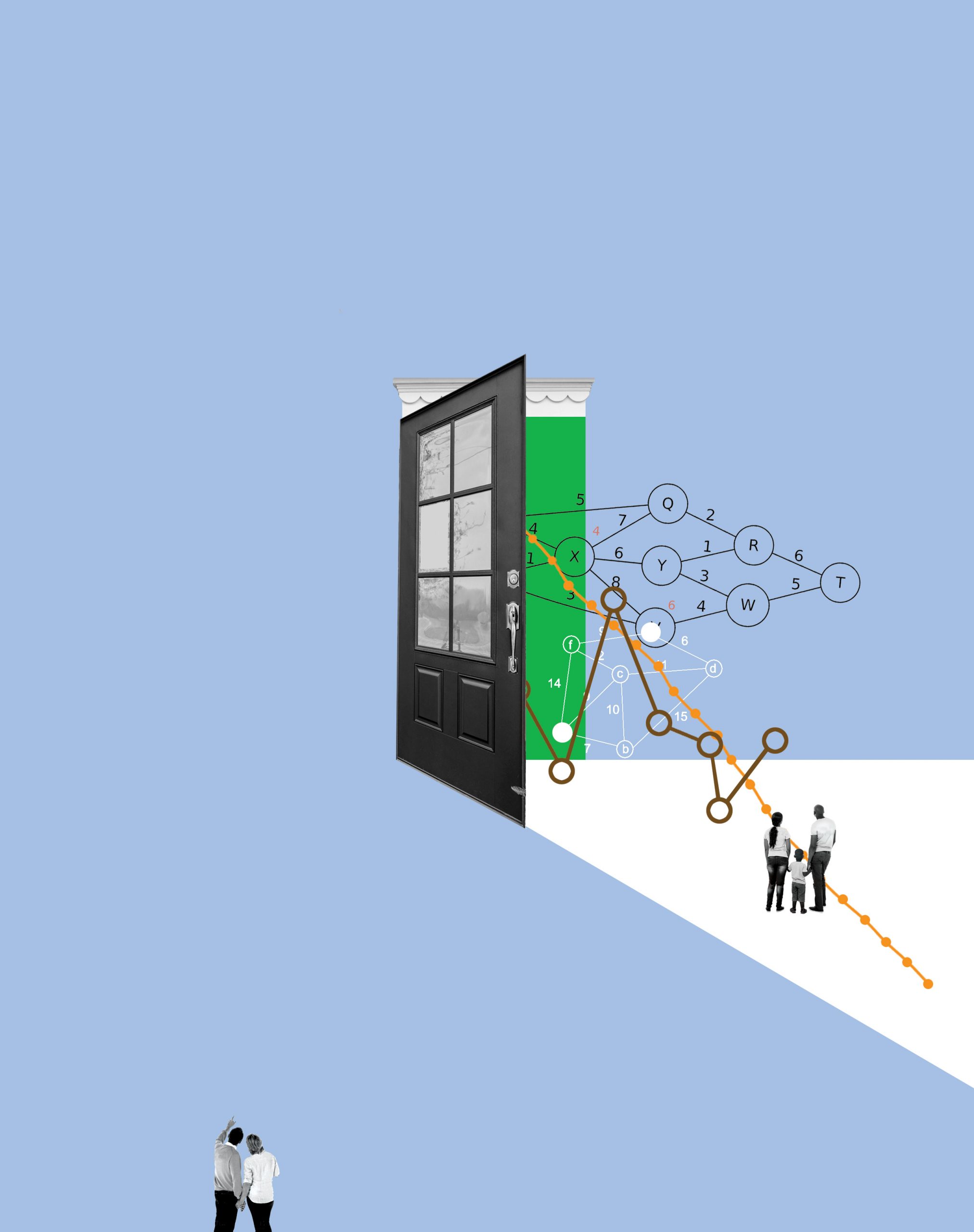

MITテクノロジーレビュー(米国版最新号)では、さまざまな長期的問題を特集している。米国の制度的な人種差別ほど、長期的または解決困難な問題はほかにあまりない。その中でも深く根づいているのが、住宅を巡る人種差別だ。

銀行、保険会社、そして不動産ブローカー(仲介業者)が長年維持してきた方針は、有色人種の人々に家を持つ正当な機会を与えず、白人と白人コミュニティに富や財産を集中させ、事実上、人種差別を永続させてきた。レッドライニング(日本版注:金融機関が特定の地域、特に有色人種が多い地域に対して住宅ローンの提供を拒否する差別的慣行)、ブロックバスティング(日本版注:不動産業者が人種的な恐怖を煽って白人に住宅を売却させ、その後高値で有色人種に転売する手法)、人種差別目的の都市計画規制、不作為約款(消極的な人種差別約款)、人種差別的不当誘導などに代表されるような方策は、現在では法的に禁止されている。しかし、その影響は根強く残り、ときには秘密裏に、または不注意でよみがえっている。

テクノロジーは、米国の制度的人種差別を悪化させてきたところがある。例えば、アルゴリズムに基づいた顔認識、予測システムを活用した予測警備、量刑と保釈の決定は、一貫して黒人に悪い結果をもたらしている。住宅分野においても、カリフォルニア大学バークレー校の最近の調査によると、人工知能(AI)を活用した住宅ローン貸付システムは、同じ住宅ローンに対して白人の借り手よりも黒人とヒスパニック系の借り手に高いコスト(手数料、金利など)を課している。

反対に、テクノロジーを活用した住宅差別の緩和は可能なのだろうか? 3人の専門家が、その可能性について議論した。

この議論は、発言の主旨を明確にするために編集および要約されている。

マキルウェイン:2019年12月に、自動化とAIが金融サービス業界に及ぼす影響について私が議会で証言したとき、人間の融資担当者とは異なり、自動住宅ローン貸付システムは人種差別なく住宅ローンを公正に承認したという直近の調査を引用しました。それでも、自動住宅ローン貸付システムは、依然として黒人やヒスパニック系の借り手に対して、手数料や金利などのコストを大幅に高く要求しています。

このことから、AIが人間よりも公平な判断をできるのか、将来的にできるようになるのか疑問を感じています。バートレット教授、私が引用したのはあなたの調査でしたが、私と同じ結論に達しましたか?

バートレット:我々は、記録から貸し手を見分け、その貸し手が、少なくとも住宅ローンの承認と引受に関して、人間がまったく介入しない完全自動化システムを使っているかどうかを特定できるデータセットにアクセスできました。借り手の人種や民族に関する情報もあったので、承認された住宅ローンの価格(手数料や金利など)が人種によって異なるかどうかを、我々は確認できました。実際、年間約8億ドルの差がありました。

借り手の人種や民族の情報を知らないアルゴリズムが、なぜこのような差別をするのか? 我々の作業仮説(暫定的な仮説)は、アルゴリズムが単に価格を最大化しようとすることが多いというものです。おそらく、アルゴリズムを設計している人が誰かに関わらず、このような収益 …

- 人気の記事ランキング

-

- This company claims a battery breakthrough. Now they need to prove it. すべてのパラメーターが矛盾——「出来すぎ」全固体電池は本物か?

- OpenAI’s “compromise” with the Pentagon is what Anthropic feared アンソロピック排除の裏で進んだオープンAIの軍事契約、その代償は

- AI is rewiring how the world’s best Go players think 「アルファ碁」から10年、 AIは囲碁から 創造性を奪ったのか

- How uncrewed narco subs could transform the Colombian drug trade 中には誰もいなかった—— コカイン密輸組織が作った 「自律潜水ドローン」の脅威