フェイスブックは5月12日に公開した最新の「コミュニティ規定施行レポート」で、ヘイトスピーチやデマを検知する人工知能(AI)システムの最新のアップデートについて発表した。今四半期に削除したヘイトスピーチの全体の88.8%がAIによって検知され、80.2%だった前四半期より増加したという。AIシステムがヘイトスピーチだと強く確信した場合、コンテンツは自動的に削除されることになっているが、ほとんどの場合は最初に人間によってチェックされている。

こうした改善は、主にフェイスブックのAIシステムに対する2つのアップデートによるものだ。まず、フェイスブックは現在、投稿内容のニュアンスと意味をより正確に解読できる、大規模な自然言語モデルを使用している。過去2年間のAI研究の進歩によって実現したもので、人間の監修なしでニューラル・ネットワークの言語トレーニングを可能にし、手動でのデータ・キュレーションによるボトルネックを解消する。

2つ目の更新は、テキストの入った画像などのコンテンツ(悪意のあるミームなど)を、フェイスブックのシステムが分析できるようになったことだ。混合メディアのコンテンツを検知するAIの能力には依然として限界があるものの、フェイスブックは新しいデータセットを公開し、より優れた検知アルゴリズムを募るコンペも立ち上げている。

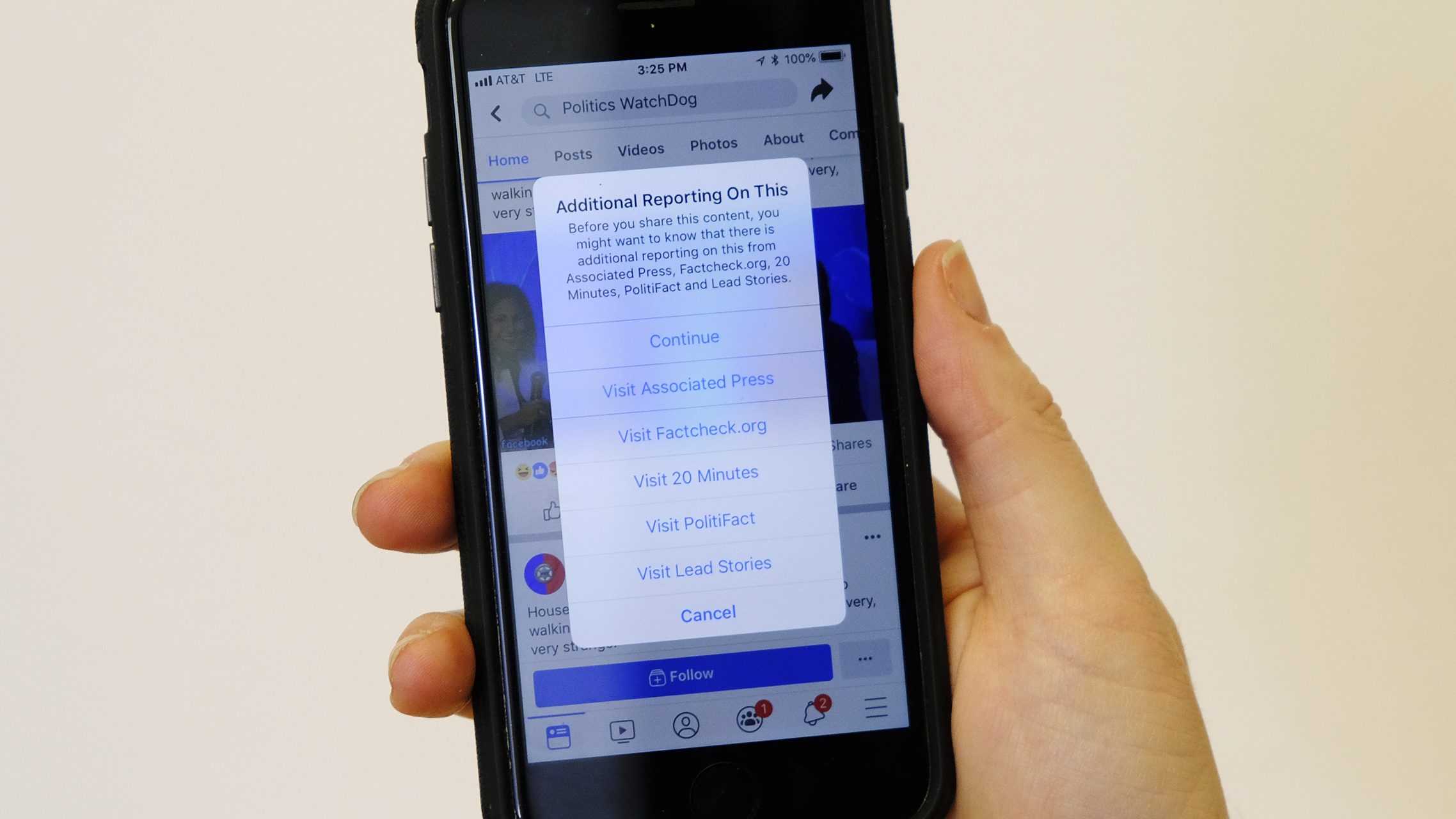

こうしたアップデートにも関わらず、AIは新型コロナウイルス感染症(COVID-19)の発生源に関する陰謀論や治療法に関するフェイクニュースなど、急増するデマへの対処で大きな役割を果たせずにいる。代わりに、フェイスブックはファクトチェックを実施する60以上のパートナー機関の評価者たちを頼りにしてきた。人間の評価者が、誤解を招く恐れのある見出しの付いた画像などのコンテンツにフラグを立てた場合にのみ、AIシステムは同一または類似のアイテムを検索する役目を引き継ぎ、警告ラベルを自動的に追加したりアイテムを削除したりする。フェイスブックのチームはデマの新たな例を見つけ出せるよう機械学習モデルを訓練できておらず、マイク・シュローファー最高技術責任者(CTO)は、「いままで見たことのないコンテンツを理解して分類するシステムの開発には、長い時間と多くのデータが必要です」と述べている。

この問題は、AIをベースにしたコンテンツ管理の限界を示している。システムは、以前目にしたものに類似するコンテンツは検知できるが、新たなデマが登場すると検知に失敗してしまう。フェイスブックは近年、より迅速に対応できるAIシステムの開発に多額を投資してきたが、これは同社だけが抱える問題ではなく、AI分野の大きな研究課題の1つであり続けている。

- 人気の記事ランキング

-

- AI companions are the final stage of digital addiction, and lawmakers are taking aim SNS超える中毒性、「AIコンパニオン」に安全対策求める声

- Promotion MITTR Emerging Technology Nite #32 Plus 中国AIをテーマに、MITTR「生成AI革命4」開催のご案内

- Anthropic can now track the bizarre inner workings of a large language model 大規模言語モデルは内部で 何をやっているのか? 覗いて分かった奇妙な回路

- This Texas chemical plant could get its own nuclear reactors 化学工場に小型原子炉、ダウ・ケミカルらが初の敷地内設置を申請

- Tariffs are bad news for batteries トランプ関税で米電池産業に大打撃、主要部品の大半は中国製

- カーレン・ハオ [Karen Hao]米国版 寄稿者

- 受賞歴のあるフリー・ジャーナリスト。人工知能が社会に与える影響について取材している。ウォール・ストリート・ジャーナル紙の海外特派員として中国のテクノロジー業界を担当。2022年4月まではMITテクノロジーレビューのAI担当上級編集者を務めた。