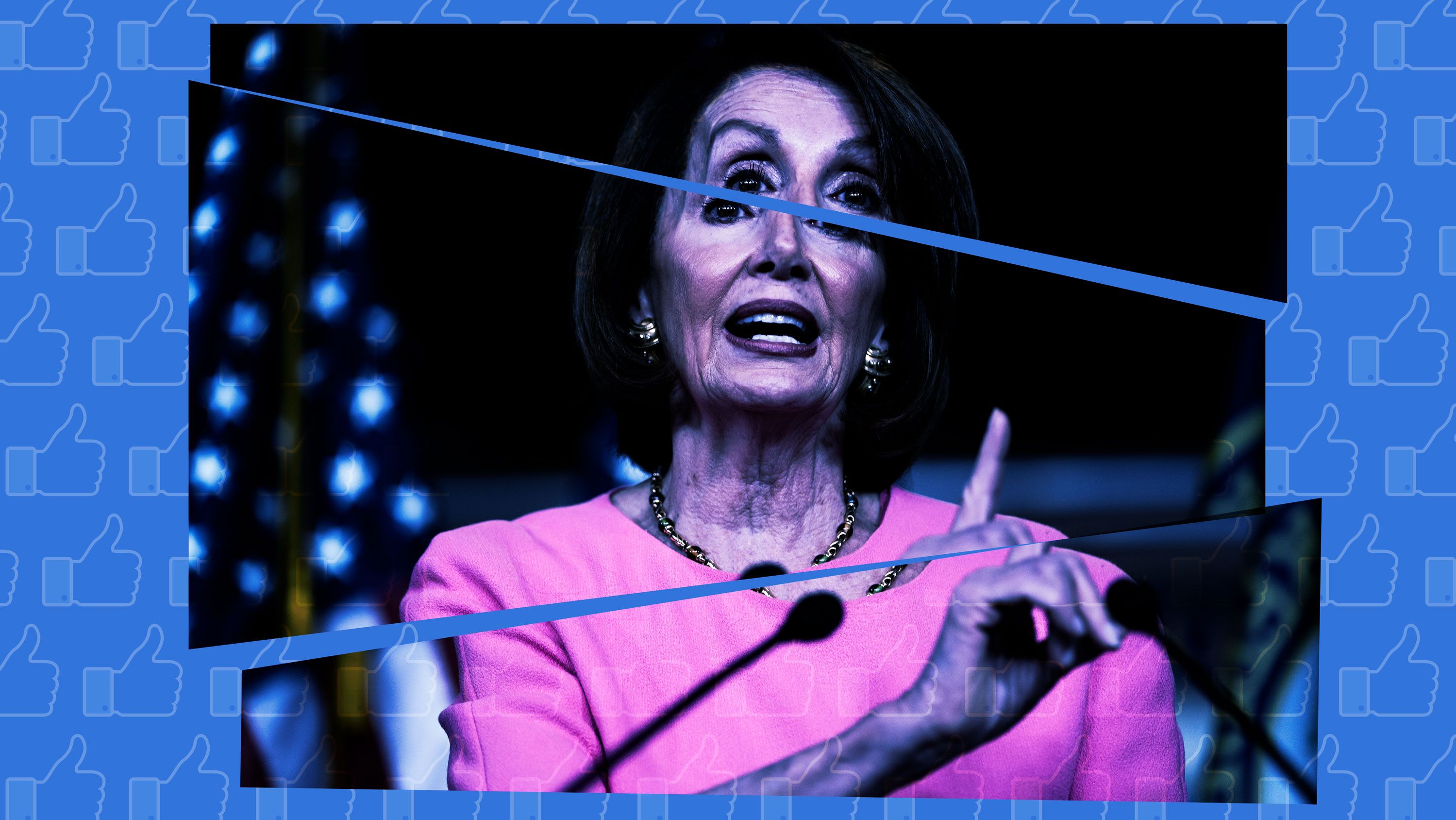

米下院議長「ろれつが回らない」動画を削除すべきではない理由

先月末に出回った米国下院議長のフェイク動画が問題になっている。悪質な動画だが、安易な削除は政治家による圧力の悪しき前例となる可能性がある。 by Angela Chen2019.06.18

ナンシー・ペロシ米国下院議長が酔っぱらって見えるように再生速度を落とした映像が出回っている。映像を削除しないフェイスブックに対して批評家からは批判が上がっているが、映像を削除すればもっと深刻な被害が実際に起こる前例を作りかねないと主張する専門家もいる。

映像はペロシ議長が奇妙に見えるように加工されてはいるが、 「ディープフェイク」ではない。つまり、彼女が実際には話していないことを話しているかのように偽造されたものではない。基本的には事実ではあるものの、誰かを貶めるために巧妙に加工された情報であり、MITメディアラボのフセイン・ドラクシャン研究員が「マルインフォメーション(malinformation:悪意ある情報)と呼ぶ事例にあたるものだ。

ドラシャン研究員は、たとえばペロシ議長が人種差別的な中傷発言をしているフェイク映像なら削除しても問題はないと考える一方で、プラットフォームに対してマルインフォメーションの取り締まりまで期待するのは行き過ぎだとしている。 「一般論として、今回のペロシ議長の映像程度の加工が非合法的な行為だとは思えません。ですから、こうした映像を削除したり、プラットフォームに削除を要求したりする根拠にはならないでしょう」。

「ヘイト・スピーチの不正な事例を削除する」というルールを定めることなら誰でも思いつく。だが、ヘイト・スピーチ以外の嘲笑や風刺 …

- 人気の記事ランキング

-

- Anthropic can now track the bizarre inner workings of a large language model 大規模言語モデルは内部で 何をやっているのか? 覗いて分かった奇妙な回路

- Promotion MITTR Emerging Technology Nite #32 Plus 中国AIをテーマに、MITTR「生成AI革命4」開催のご案内

- AI companions are the final stage of digital addiction, and lawmakers are taking aim SNS超える中毒性、「AIコンパニオン」に安全対策求める声

- What is vibe coding, exactly? バイブコーディングとは何か? AIに「委ねる」プログラミング新手法

- Tariffs are bad news for batteries トランプ関税で米電池産業に大打撃、主要部品の大半は中国製