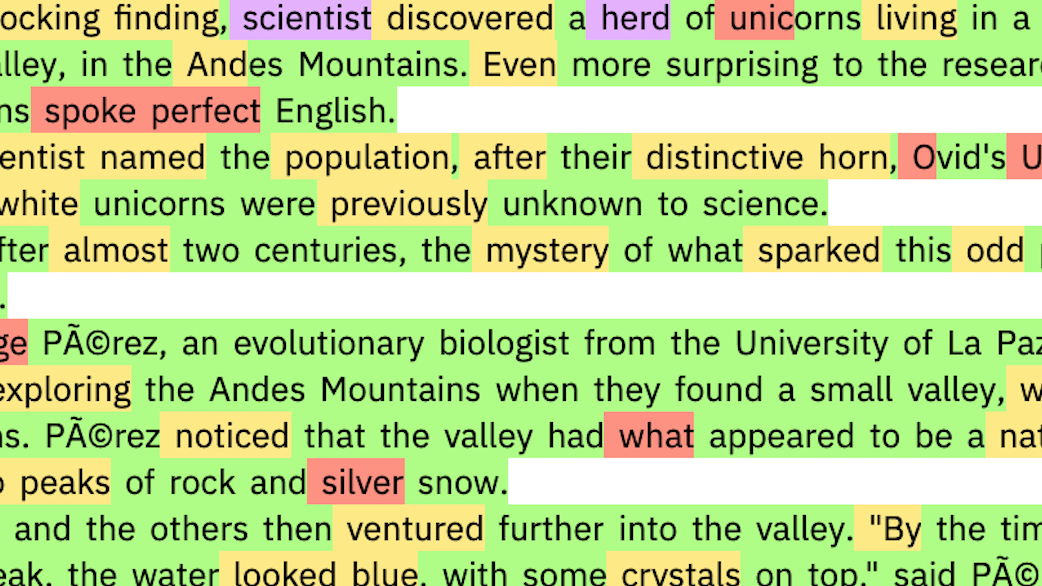

オープンAI(OpenAI)は2019年2月、最新の言語モデル「GPT-2」を発表した。発表が大々的にではなくむしろ控えめだったのは、GPT-2がデマの自動大量生産に利用されるのを恐れたからだった。さらにこの発表によって、AIコミュニティで続いているフェイクニュースの検出方法に関する議論に拍車がかかっている。MIT-IBMワトソンAI研究所とハーバードNLPの研究チームによる新しい実験では、「説得力のある文章を書ける言語モデルは、他のモデルが生成した一節を見抜けるかどうか」が考察された。

この仮説を成す考え方は単純なものだ。言語モデルは文の流れにおいて次の単語を予測して文章を作り出していく。そこで、与えられた一節の単語を容易に予測できれば、おそらく同じ言語モデルによって書かれたも …

- 人気の記事ランキング

-

- China built hundreds of AI data centers to catch the AI boom. Now many stand unused. AIデータセンター 中国でバブル崩壊か? 需要低迷で大量放置の実態

- Promotion MITTR Emerging Technology Nite #32 Plus 中国AIをテーマに、MITTR「生成AI革命4」開催のご案内

- How 3D printing could make better cooling systems 3Dプリントで製造の制約を解放、高効率な熱交換器が設計可能に

- Brain-computer interfaces face a critical test 使用者は世界100人未満、 脳インターフェイスは 本当に実用化できるか?

- The foundations of America’s prosperity are being dismantled 崩壊する科学エコシステム、 トランプ政権がもたらす 「取り返しのつかない損害」