グーグル、本物の犬の動きをロボット犬に教え込む

グーグルの研究チームは、模倣学習を使って、ロボットがより機敏に歩き、方向を変え、移動する方法を教えている。

研究チームはこのほど、1匹の犬に装着したさまざまなセンサーから得られたモーション・キャプチャーのデータを使い、「ライカゴ(Laikago)」と名付けられた4本足ロボットに対して、従来の手動のコーディングによるロボット制御では困難な動きを体得させた。

まず始めに、研究チームはそれぞれの動きのシミュレーションを構成するため、本物の犬から得たモーション・データを利用した。犬の小走り、サイドステップ、そして80年代の古典的なダンスの動きである「ランニングマン(running man)」の犬バージョンの動きなどだ。ただし、ランニングマンのデータは本物の犬ではなく、シミュレーションデータから手動で犬のダンスのアニメーションを作成し、ロボットに適用可能か確認した。次に、研究チームは、シミュレーションされた犬とロボットの主要な関節を組み合わせ、ロボットが実際の動物とまったく同じ動きをするよう調整した。その後、強化学習を用いてロボット犬は各動作を安定させ、体重分布と設計の違いを修正できるようになった。最後に研究チームは、最終的な制御アルゴリズムを物理的なロボット犬に移植することに成功した。なお、ランニングマンなど一部の動きについては、完全には実現できなかった。

実世界を動き回るのに必要な複雑で機敏な動きをロボットに体得させることは、ロボット工学における長年の課題となっている。今回発表されたような模倣学習は、機械が動物や人間の持つ機敏さを容易に取り入れることを可能にするものだ。

研究論文の筆頭筆者であるジェイソン・ペンは、依然として克服すべき課題がいくつか残っているという。たとえばロボットの重さが、大きくジャンプしたりすばやく走るといった特定の動作習得に制限をかけている。加えて、実際の動物から常にモーション・センサーデータが取れるとは限らないという問題もある。場合によっては非常に高いコストがかかったり、動物の協力が必要な場合もある。たとえば、犬は人間に対し友好的だが、チーターはそうでもない。研究チームは動物から協力を得る代わりに、動物の映像を活用する計画を立てている。これが可能なら、研究チームの手法ははるかに利用しやすく、拡張性の高いものとなるだろう。

4月6日9時25分更新:タイトルの誤字を修正しました。

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

オープンAIが「年齢予測」導入、子ども保護の責任誰が負う?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

MITの学生は「世界を変える10大技術」から何を学んでいるか?

eムック 『AIバブル臨界点 見えてきた真の実力』特集号

eムック 『AIバブル臨界点 見えてきた真の実力』特集号

期待外れのCRISPR治療、包括的承認で普及目指す新興企業

期待外れのCRISPR治療、包括的承認で普及目指す新興企業 書評:サム・アルトマンはいかにして「AI帝国」を築いたか

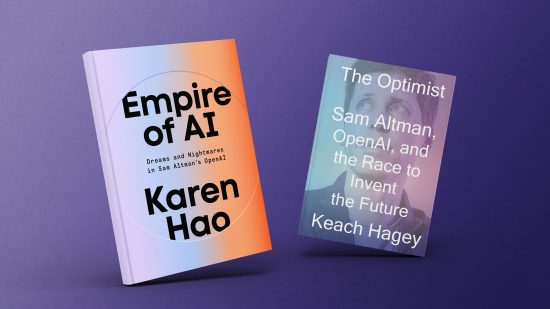

書評:サム・アルトマンはいかにして「AI帝国」を築いたか