偏見的アルゴリズム12 Stories

-

-

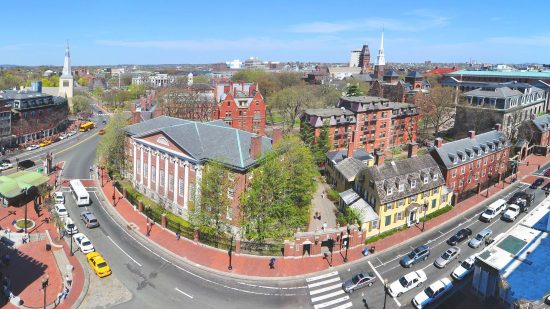

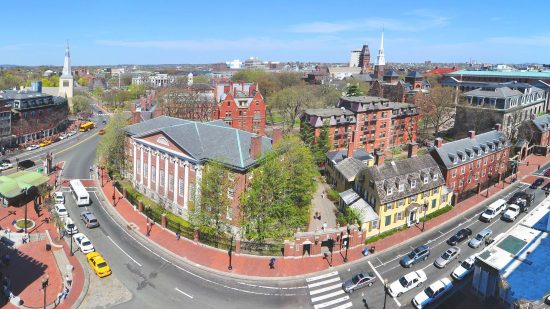

議会での的外れな質問防げ、

ハーバード大学が議員向け

「AIブートキャンプ」実施

-

日本ではパソコンを自分で打たないサイバーセキュリティ担当大臣が話題だが、米国では議員の人工知能(AI)に対する知識不足が問題となっている。ハーバード・ケネディー・スクールの主任研究員らが立ち上げたイニシアティブでは、議員らを対象としたブートキャンプ(集中特訓)を実施し、AIのテクノロジーや倫理的問題について学んでもらう考えだ。

Karen Hao7年前

-

-

MSやフェイスブックが「AIのバイアス」対策に乗り出す理由

-

人工知能(AI)が重要な場面の意思決定の自動化や支援に使われる機会が増えるにつれて、アルゴリズムに偏向が含まれる問題の重大性が高まっている。マイクロソフトやフェイスブックは、AIアルゴリズムに含まれる偏向を自動的に発見する独自ツールの開発を進めている。

Will Knight7年前

-

-

グーグルはいかにして

ヘイト、テロ、デマと

戦ってきたか

-

アルファベット(グーグル)傘下のジグソーのメンバーは、ときに紛争地へ飛ぶこともある。インターネットを悪用したテロやフェイクニュース、荒らしといった問題と戦うテクノロジーを開発するためだ。これまでの取り組みをヤスミン・グリーン研究開発部長が語った。

Martin Giles7年前

-

-

検索エンジンの差別、

何が問題なのか?

-

検索エンジンの仕事ぶりは差別のない公平なものからは程遠い。そう指摘するカリフォルニア大学ロサンゼルス校(UCLA)のサフィア・ウモジャ・ノーブル教授に問題点を聞いた。

Jackie Snow7年前

-

-

バイアスなきAIのために

いま何をするべきか?

-

機械学習のトップカンファレンスに参加したAI研究者のティムニット・ゲブルは、黒人の参加者がわずか数人しかいないことに衝撃を受けた。ゲブルは、社会に急速に広まりつつあるAIの多様性を確保するために、いますぐ行動を始めなければならないと訴える。

Jackie Snow7年前

-

-

リンクトイン創業者が語った、シリコンバレーをよりよくする方法

-

リンクトインの共同創業者でベンチャー投資家のリード・ホフマンはシリコンバレーの悪い文化を変えようとしている。テック業界や投資業界における嫌がらせや差別の問題、技術の進歩によって職を奪われた人たちに対し何をするべきか? について語った。

Elizabeth Woyke8年前

-

-

ブラックボックスなAIに潜む「偏見」を暴く最新研究が発表

-

意思決定の場面に人工知能(AI)システムが使われることが多くなるにつれて、ブラックボックスの中で一体どのようなアルゴリズムが動作しているのかを知ることが、ますます重要になっている。しかし、処理が複雑すぎたり、アルゴリズムが公開されていなかったりして、動作を調べるのが困難である場合がほとんどだ。

Jackie Snow8年前

-

-

殺人ロボよりも現実的なAIの脅威

-

企業でのAIの展開を支援するコグニション・エックス(CognitionX)の共同設立者タバサ・ゴールドスタウは、人間が持つ無意識の先入観がAIに与える影響について危惧している。

MIT Technology Review Editors8年前

-

-

人工知能から差別や偏見を排除できるのか?

-

米国では被告人を仮釈放すべきかどうか、裁判官に助言するソフトウェアが使われている。ローンの審査や人材採用に人工知能を活用する企業もある。こうした人生を左右する決定に使われるコンピューターから、差別や偏見を排除できるのだろうか? ハーバード大学のコンピュータ科学者であるシンシア・ドゥーワーク教授は、人工知能が公平に判断していることを確認する方法を開発している。

MIT Technology Review Editors8年前

-

-

ツイッター分析ツールの「意見」は偏っている

-

自然言語アルゴリズムは特定の少数の方言や話し方を差別している。しかし、単にアルゴリズムを糾弾するだけでは問題の解決にはならず、アルゴリズムが何をしているのかを明確にして、それがふさわしいかどうかを人間が判断する必要がある。

Will Knight8年前

-

-

機械は偏見を持つのか?

犯罪者予測システムの

是非を問う

-

米国の裁判所や金融機関では多くの場面で、被告人や顧客に対する意志決定に自動化システムを使っている。機械を使えば、人間の持つ偏見をなくして公平な判断を下すことが可能になるのだろうか。

Matthias Spielkamp8年前

-

-

人工知能は数学的処理でも

アルゴリズムの偏向は不可避

-

アルゴリズムは公平で、開発者である人間よりも客観的だと考えがちだが、研究者は、偏見や差別があることを証明した。

Nanette Byrnes9年前

- フォローしてください重要なテクノロジーとイノベーションのニュースをSNSやメールで受け取る

-