人工知能(AI) 2023年12月の記事

-

-

This company is building AI for African languages

LLM時代の言語危機に立ち向かうアフリカのスタートアップ - チャットGPTをはじめとするAIモデルは多様なアフリカの言語をほとんど理解できない。こうした現状を変えるべく、複数のスタートアップが、アフリカの人々に役立つAIを構築しようと取り組みを進めている。 by Abdullahi Tsanni2023.12.27

-

This company is building AI for African languages

-

- 激動の「生成」ブームに揺れた2023年のAIシーンを振り返る

- 2023年は人工知能(AI)分野を揺るがす大きな出来事が相次いだ1年となった。競争激化でテクノロジーが大きく進歩しただけでなく、欧米ではAIの規制に向かう大きな動きもあった。2023年の出来事を4つの視点から振り返る。 by Melissa Heikkilä2023.12.24

-

- 主張:生成ブームでも結局、AIは巨大テック企業に支配されている

- オープンAIの騒動で明らかになったのは、AI業界における巨大テック企業の影響力だった。当局による規制も、資金力と影響力を利用して自身に都合よいものにしてしまう可能性がある。 by Meredith Whittaker2023.12.21

-

- 生成AIアシスタントはプログラマーの仕事をどう変えているか

- 生成AIによるコーディング・アシスタント機能が高機能化し、実際に利用するプログラマーが増えている。AIアシスタントはソフトウエア開発にどれほどの違いをもたらし、業界にどのような影響を与えるのだろうか。 by Will Douglas Heaven2023.12.21

-

- iPhoneで事前学習、家事ロボット新手法は成功率81%

- 家庭用ロボットの実用化には、大量の訓練用データをいかに用意するかという課題がある。ニューヨーク大学の研究チームは、iPhoneを使ったデータ収集方法を新たに考案。30日にわたってテストした。 by Rhiannon Williams2023.12.20

-

-

Google DeepMind used a large language model to solve an unsolvable math problem

ディープマインド、大規模言語モデルで数学の未解決問題を解く - グーグル・ディープマインドは、大規模言語モデル(LLM)で純粋数学の有名な未解決問題を解くことに成功したと発表した。LLMが、訓練データに含まれない未知の解を導き出すことに成功した例になる。 by Will Douglas Heaven2023.12.19

-

Google DeepMind used a large language model to solve an unsolvable math problem

-

-

People shouldn’t pay such a high price for calling out AI harms

AIがもたらす「今そこにある危機」と闘う研究者 - AIシステムを開発する大手テック企業は、未来のAIがもたらす可能性がある危機についてアピールしている。だが、これはすでに存在するAIシステムがもたらしている実際の被害や危険性を見えなくするものだ、という主張にも耳を傾けるべきだ。 by Melissa Heikkilä2023.12.18

-

People shouldn’t pay such a high price for calling out AI harms

-

-

We need to focus on the AI harms that already exist

主張:未来の脅威よりも深刻な現実のAI被害を直視すべき理由 - 先駆的なAI倫理の研究で知られるジョイ・ブオラムウィニ博士は、将来の危機を恐れるあまり、AIシステムがすでに人々を傷つけている事実が見えなくなっていると主張する。 by MIT Technology Review Editors2023.12.17

-

We need to focus on the AI harms that already exist

-

-

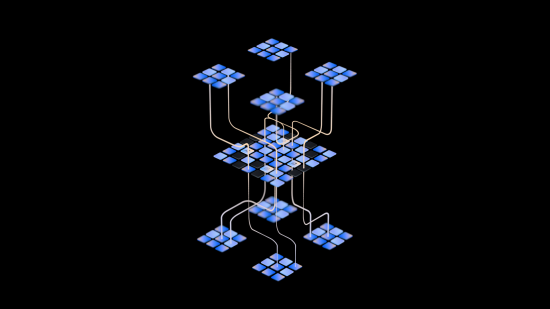

Now we know what OpenAI’s superalignment team has been up to

人工「超知能」暴走防止へ、オープンAIが初成果を発表 - オープンAIは、「人工超知能」の暴走を防ぐために社内に組織したチームによる研究成果の第一弾を発表した。その手法は、比較的性能が劣る大規模言語モデルに、より強力な大規模言語モデルを監督させるというものだ。 by Will Douglas Heaven2023.12.15

-

Now we know what OpenAI’s superalignment team has been up to

-

-

AI's carbon footprint is bigger than you think

予想以上に多かった、生成AIの二酸化炭素排出量 - 生成AIを使って1つの画像を生成するには、スマートフォンをフル充電するのと同じくらいのエネルギーが必要だという研究が発表された。具体的な数字が計測されたことで、今後のAIの使用法などを考えるきっかけとなりそうだ。 by Melissa Heikkilä2023.12.15

-

AI's carbon footprint is bigger than you think

-

-

Making an image with generative AI uses as much energy as charging your phone

AI画像生成のエネルギー消費量、スマホのフル充電に匹敵 - ハギング・フェイスとカーネギー・メロン大学の研究グループは、生成AIモデルによるエネルギー消費量と二酸化炭素排出量を調べた研究成果を発表した。特に画像生成モデルでは大量のエネルギーを消費することが分かり、モデルの訓練だけでなく「使用」時の省エネ化が課題として浮き彫りになった。 by Melissa Heikkilä2023.12.14

-

Making an image with generative AI uses as much energy as charging your phone

-

-

Five things you need to know about the EU’s new AI Act

欧州以外も無関係ではないEU「AI法」 5つの重要ポイント - 2年半にわたって協議されてきたEUの「AI法」がついに合意に達した。重要かつ法的拘束力を備えた、透明性と倫理に関する規則の先駆けとなる、世界初の包括的なAI規制だ。 by Melissa Heikkilä2023.12.13

-

Five things you need to know about the EU’s new AI Act

-

-

These robots know when to ask for help

「分からなかったら聞いて」を実践するロボット新技術 - 人間のあいまいな指示ではロボットは判断を誤り、事故を起こす可能性がある。最近発表された「KnowNo」は、大規模言語モデルと信頼度を定量化する統計ツールを組み合わせることで、人間に助けを求めるよう訓練するモデルだ。 by June Kim2023.12.11

-

These robots know when to ask for help

-

-

Google CEO Sundar Pichai on Gemini and the coming age of AI

単独ロングインタビューサンダー・ピチャイが語るGeminiとAI新時代 - グーグルは12月6日、オープンAIに対抗する最先端のAIモデル「ジェミナイ(Gemini)」を発表した。発表の前夜、グーグルのピチャイCEOがMITテクノロジーレビューのロングインタビューに応じ、ジェミナイが自社やAI、社会全体に対して与える影響について語った。 by Mat Honan2023.12.11

-

Google CEO Sundar Pichai on Gemini and the coming age of AI

-

-

Google Deepmind's new Gemini model looks amazing—but could signal peak AI hype

グーグルがGPT-4対抗「Gemini」投入、AIの限界広げるか - グーグル・ディープマインドは12月6日に、「GPT-4」対抗馬として以前から噂の「ジェミナイ(Gemini)」を発表した。同社は、ほとんどの面でGPT-4に勝るとしているが、その差はごくわずかであるように思える。 by Will Douglas Heaven2023.12.7

-

Google Deepmind's new Gemini model looks amazing—but could signal peak AI hype

-

-

Google DeepMind’s new AI tool helped create more than 700 new materials

ディープマインドが材料革命、700以上の新素材をAIで探索 - ディープマインドが新材料を探索するAIシステムを発表した。太陽電池、バッテリー、半導体など、性能向上に新しい材料を求めている分野は数え切れないほどある。従来、新材料の探索は完全に人手に頼っていたため、効率が悪く、長い時間がかかっていた。 by June Kim2023.12.6

-

Google DeepMind’s new AI tool helped create more than 700 new materials

-

-

China has a new plan for judging the safety of generative AI—and it's packed with details

中国テック事情:回答拒否率も規定、驚くほど具体的な生成AI規制案 - 中国政府機関が生成AIの規制に関する草案文書を発表した。同文書は、テック企業が実施すべきセキュリティ評価とその評価基準について、非常に具体的な方法を明確に示しており、参考になりそうなところも多い。 by Zeyi Yang2023.12.5

-

China has a new plan for judging the safety of generative AI—and it's packed with details

-

-

Exclusive: Ilya Sutskever, OpenAI’s chief scientist, on his hopes and fears for the future of AI

独占:アルトマン解任前夜、渦中の人物が語っていた人工超知能への期待と恐怖 - オープンAI(OpenAI)のサム・アルトマンCEOの電撃解任を主導したとされるのが、同社の共同創業者であるイリヤ・サツケバー主任科学者だ。MITテクノロジーレビューは騒動の1カ月前に独占インタビューを実施していた。インタビューからはサツケバーが目指していたAIの方向性が浮かび上がる。 by Will Douglas Heaven2023.12.4

-

Exclusive: Ilya Sutskever, OpenAI’s chief scientist, on his hopes and fears for the future of AI

-

-

Unpacking the hype around OpenAI’s rumored new Q* model

算数が解けるオープンAIの噂の新モデル「Q*」、専門家の見立ては - アルトマンCEO解任から一転して復帰の喧噪も冷めやらぬ間に、今度はオープンAIが小学校の算数の問題を解けるAIモデルを開発したと報じられた。汎用人工知能に近づいたと色めき立つ向きもあるが、噂に過度な期待は禁物だ。 by Melissa Heikkilä2023.12.3

-

Unpacking the hype around OpenAI’s rumored new Q* model

- アーカイブ

-

- 2025年4月

- 2025年3月

- 2025年2月

- 2025年1月

- 2024年12月

- 2024年11月

- 2024年10月

- 2024年9月

- 2024年8月

- 2024年7月

- 2024年6月

- 2024年5月

- 2024年4月

- 2024年3月

- 2024年2月

- 2024年1月

- 2023年12月

- 2023年11月

- 2023年10月

- 2023年9月

- 2023年8月

- 2023年7月

- 2023年6月

- 2023年5月

- 2023年4月

- 2023年3月

- 2023年2月

- 2023年1月

- 2022年12月

- 2022年11月

- 2022年10月

- 2022年9月

- 2022年8月

- 2022年7月

- 2022年5月

- 2022年4月

- 2022年3月

- 2022年2月

- 2022年1月

- 2021年12月

- 2021年11月

- 2021年10月

- 2021年9月

- 2021年8月

- 2021年7月

- 2021年6月

- 2021年5月

- 2021年4月

- 2021年3月

- 2021年2月

- 2021年1月

- 2020年12月

- 2020年11月

- 2020年10月

- 2020年9月

- 2020年8月

- 2020年7月

- 2020年6月

- 2020年5月

- 2020年4月

- 2020年3月

- 2020年2月

- 2020年1月

- 2019年12月

- 2019年11月

- 2019年10月

- 2019年9月

- 2019年8月

- 2019年7月

- 2019年6月

- 2019年5月

- 2018年11月

- 2018年10月

- 2017年10月