人工知能(AI) 2023年9月の記事

-

-

These new tools could make AI vision systems less biased

AIビジョンのバイアス低減へ、ソニーとメタが新ツール - AIビジョンシステムにバイアスがあることは以前から指摘されている。ソニーとメタはそれぞれ、バイアスを発見する従来の方法自体にも偏りがあるとして、バイアスの検出をより公平にするための新しい方法を発表した。 by Melissa Heikkilä2023.9.29

-

These new tools could make AI vision systems less biased

-

- ゲッティが生成AIに参入、クリエイターに補償へ

- 画像ライブラリ販売大手のゲッティイメージズが生成AIシステムを発表した。AIモデルの訓練に著作権者の同意がある画像のみを使用し、顧客は心配なく利用できるという。クリエイターには補償金を支払う方針だ。 by Melissa Heikkilä2023.9.28

-

- 生成AIの次は「双方向」ディープマインド共同創業者スレイマンが見据える未来

- ディープマインドの共同創業者であるムスタファ・スレイマンは、新会社インフェクション(Inflection)で今年、チャットGPTのライバルとなる「パイ(Pi)」を公開した。独自の信念を持つスレイマンに話を聞いた。 by Will Douglas Heaven2023.9.28

-

- 声でしゃべれるチャットGPTが登場、写真の内容も質問可能に

- オープンAIは、チャットGPTの過去最大のアップデートを発表した。音声によるやり取りに対応し、アップロードした画像の内容についてもやり取りできるようになる。 by Will Douglas Heaven2023.9.27

-

- ギャレス・エドワーズ監督、最新作でAI生成音楽に挑んで得た教訓

- 映画「ローグ・ワン/スター・ウォーズ・ストーリー」の監督であるギャレス・エドワーズは、最新作『ザ・クリエイター/創造者』のサウンドトラックをAIに作らせようと考えた。AIが作った楽曲は結悪くなかったが、最終的には採用を見送ったという。 by Melissa Heikkilä2023.9.26

-

-

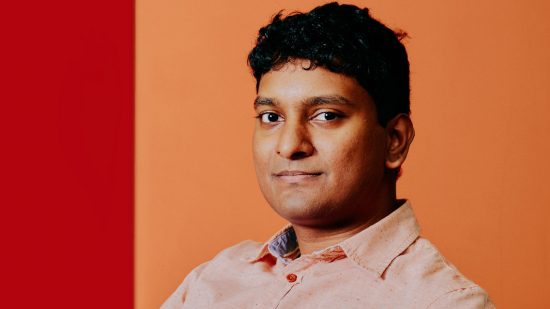

2023 Innovator of the Year: As AI models are released into the wild, Sharon Li wants to ensure they’re safe

AIの暴走防ぐ研究者、「知らないことを知る」安全性組み込む - AIモデルの弱点として、未知の状況に遭遇した際に悲劇的な失敗をすることがある。ウィスコンシン大学のシャロン・リー助教授の研究の狙いは、訓練されていない状況にAIが直面した際の安全性を確保することだ。 by Melissa Heikkilä2023.9.26

-

2023 Innovator of the Year: As AI models are released into the wild, Sharon Li wants to ensure they’re safe

-

-

There's never been a more important time in AI policy

「AI規制の秋」到来、論点ずらしに動く巨大テック企業 - 米国と欧州で、人工知能(AI)の法規制を検討する動きが加速している。慎重だった米国の政治家もさまざまな提案を打ち出しているが、巨大テック企業は規制を骨抜きにしようと動いている。 by Melissa Heikkilä2023.9.22

-

There's never been a more important time in AI policy

-

-

Deepfakes of Chinese influencers are livestreaming 24/7

AI生成インフルエンサーが24時間稼ぎ続ける中国ライブコマース新事情 - 中国で真夜中のライブ配信を見ると、熱心に商品を売り込むストリーマーの姿が目立つ。だが実はこのストリーマー、わずか数分の動画からAIが生成したもので、24時間年中無休で働き続けることができる。 by Zeyi Yang2023.9.21

-

Deepfakes of Chinese influencers are livestreaming 24/7

-

-

This driverless car company is using chatbots to make its vehicles smarter

自動運転にもLLM革命、チャットで賢くなるAIドライバー - チャットGPTのような大規模言語モデル(LLM)をロボット工学に用いる動きが広がっている。自動運転車を開発するスタートアップ企業のウェイヴ(Wayve)は、LLMと自動運転ソフトを組み合わせることで、安全性を高められるという。 by Will Douglas Heaven2023.9.20

-

This driverless car company is using chatbots to make its vehicles smarter

-

-

Why we should all be rooting for boring AI

生成AIの「キラキラしない」未来に期待する理由 - 生成AIブームは軍事分野にも影響を与え、スタートアップは活況を呈している。だが、人間の生命に直接関わるような用途よりも、もっと退屈でつまらない仕事でAIを使うべきだ。 by Melissa Heikkilä2023.9.20

-

Why we should all be rooting for boring AI

-

-

AI just beat a human test for creativity. What does that even mean?

AIが創造性テストで人間に勝利、その衝撃結果が意味すること - 創造性を評価する人間向けのテストで、大規模言語モデルが人間よりも好成績を収めたとする研究が発表された。ただし、この結果から、AIが創造性を備えるようになったと捉えるのは早計だ。 by Rhiannon Williams2023.9.19

-

AI just beat a human test for creativity. What does that even mean?

-

-

Inside the messy ethics of making war with machines

戦争とAI曖昧化する責任の境界線 - 人工知能(AI)が戦場で人間の意思決定を支援することが一般的になりつつある。だが、問題が起こったときに責任を負うべきは誰なのだろうか。その境界線は曖昧になりつつある。 by Arthur Holland Michel2023.9.19

-

Inside the messy ethics of making war with machines

-

-

Robots that learn as they fail could unlock a new era of AI

失敗から学ぶAIが家庭用ロボットの新時代を開く - 多機能ロボットを開発して家庭に普及させたいニューヨーク大学のピント助教授は、ロボットに失敗から学ばせるようにすれば、AIモデル構築のネックとなる大量の訓練用データを用意する必要がなくなると考えている。 by Will Douglas Heaven2023.9.15

-

Robots that learn as they fail could unlock a new era of AI

-

-

Trajectory of U35 Innovators: Takahiro Mizoguchi

溝口貴弘:触覚を持つロボットの普及で人手不足に立ち向かう起業家 - モーションリブのCEO 溝口貴弘は、日本の労働人口減少を見据え、繊細な力加減が必要な作業をロボットが人に代わってできるようにする「リアルハプティクス」技術の社会実装・普及に力を注いでいる。 by Yasuhiro Hatabe2023.9.14

-

Trajectory of U35 Innovators: Takahiro Mizoguchi

-

-

Chinese AI chatbots want to be your emotional support

中国テック事情:ついに解禁、チャットGPT風AIを使ってみた - バイドゥのAIチャットボット「アーニー・ボット」がついに中国国内で一般向けに公開された。実際に使ってみると、チャットGPTなどの先行サービスに比べて、ユーザーを支援する工夫を随所に盛り込んでいることが分かる。 by Zeyi Yang2023.9.13

-

Chinese AI chatbots want to be your emotional support

-

-

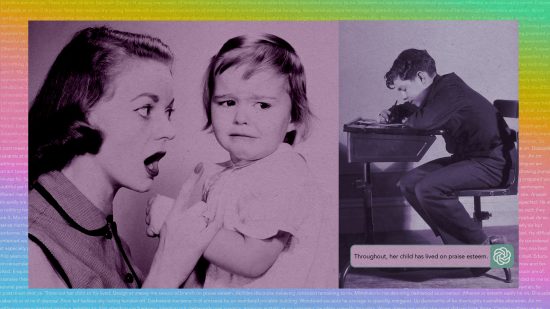

You need to talk to your kid about AI. Here are 6 things you should say.

AIと安全に付き合うには? 子どもに伝えたい6つのポイント - チャットGPTの登場でAIに誰もが触れる機会が増えてきた現在、AIとの正しい付き合い方について子どもたちにどのように教えればよいのだろうか。 by Melissa Heikkilä2023.9.12

-

You need to talk to your kid about AI. Here are 6 things you should say.

-

-

These new tools could help protect our pictures from AI

生成AIからあなたの画像を守る、最新AIツール - 生成AIによるディープフェイク被害が懸念される中、画像の改変を防ぐ技術が登場している。ただ、問題はテック大手やソーシャルメディア・プラットフォームが採用するかどうかだ。 by Melissa Heikkilä2023.9.8

-

These new tools could help protect our pictures from AI

-

-

Google DeepMind has launched a watermarking tool for AI-generated images

グーグルがAI生成画像に電子透かし、大手テック企業で初 - 生成AIが爆発的に広がる中、AI生成画像による被害が広がっている。AI生成画像に「電子透かし」を入れるツールを、グーグルが大手テック企業としては初めてサービスに組み込んだ。 by Melissa Heikkilä2023.9.5

-

Google DeepMind has launched a watermarking tool for AI-generated images

-

-

Chinese ChatGPT-alternatives receive government approval for widespread public access

バイドゥ、チャットGPT風AIボットを一般提供 政府認可を取得 - バイドゥは、チャットGPT風のAIチャットボット「アーニー・ボット」の一般提供を開始すると発表した。同社を含む複数のサービスが中国政府の認可を得た模様だ。 by Zeyi Yang2023.9.1

-

Chinese ChatGPT-alternatives receive government approval for widespread public access

- アーカイブ

-

- 2024年11月

- 2024年10月

- 2024年9月

- 2024年8月

- 2024年7月

- 2024年6月

- 2024年5月

- 2024年4月

- 2024年3月

- 2024年2月

- 2024年1月

- 2023年12月

- 2023年11月

- 2023年10月

- 2023年9月

- 2023年8月

- 2023年7月

- 2023年6月

- 2023年5月

- 2023年4月

- 2023年3月

- 2023年2月

- 2023年1月

- 2022年12月

- 2022年11月

- 2022年10月

- 2022年9月

- 2022年8月

- 2022年7月

- 2022年5月

- 2022年4月

- 2022年3月

- 2022年2月

- 2022年1月

- 2021年12月

- 2021年11月

- 2021年10月

- 2021年9月

- 2021年8月

- 2021年7月

- 2021年6月

- 2021年5月

- 2021年4月

- 2021年3月

- 2021年2月

- 2021年1月

- 2020年12月

- 2020年11月

- 2020年10月

- 2020年9月

- 2020年8月

- 2020年7月

- 2020年6月

- 2020年5月

- 2020年4月

- 2020年3月

- 2020年2月

- 2020年1月

- 2019年12月

- 2019年11月

- 2019年10月

- 2019年9月

- 2019年8月

- 2019年7月

- 2019年6月

- 2019年5月

- 2017年10月