プロンプトからバーチャル世界、生成AIで進化するロボット学習

ChatGPTで生み出した何千もの環境説明から、多様な条件下の訓練映像を自動生成する——。MITの研究チームが開発した新システムは、ロボットの学習効率を劇的に向上させた。 by Rhiannon Williams2024.11.13

ロボットに新しい環境のナビゲーションを教えるのは難しい。人間が記録した実際の物理世界のデータを使ってロボットを訓練することはできるが、そのようなデータは限られており、収集にはコストがかかる。デジタル・シミュレーションは、ロボットに新しいことを教えるための迅速でスケーラブルな方法だが、ロボットをバーチャル世界から現実世界に移して同じタスクを実行させようとすると、失敗することが多々ある。

だが、今ではより良い選択肢が存在する。生成AIモデルと物理シミュレーターを組み合わせて、現実世界により忠実なバーチャル訓練環境を構築する新しいシステムである。この方法で訓練されたロボットは、従来の手法で訓練されたロボットよりも、現実世界のテストで高い成功率を収めた。

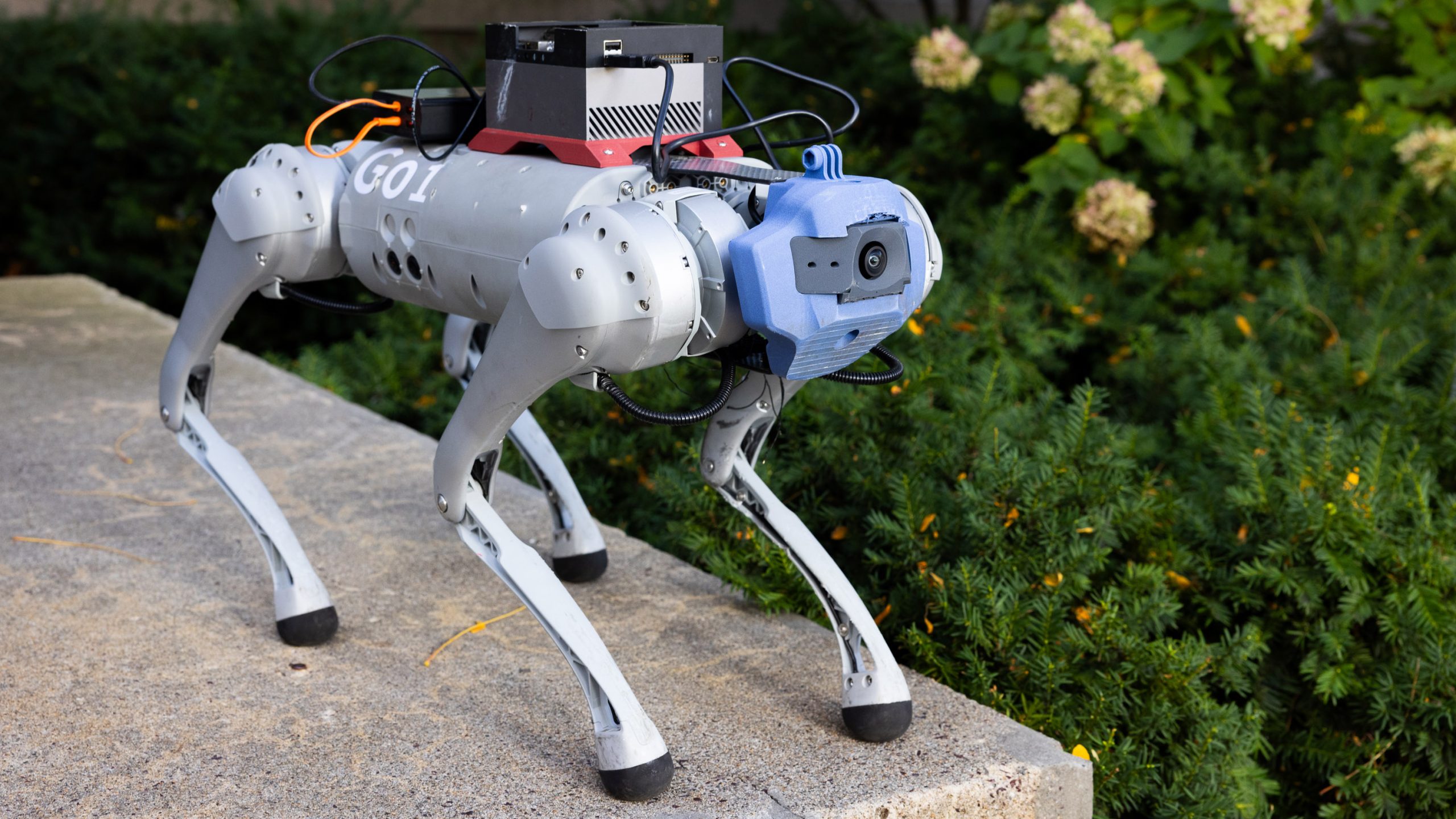

研究者たちは、「ルーシドシム(LucidSim)」と呼ばれるこのシステムを使って、ロボット犬にパルクールの訓練を実施し、現実世界のデータを一度も見たことがないにもかかわらず、箱を乗り越えたり階段を登ったりできるようにした。このアプローチは、ロボットに難しいタスクを教える際に、生成AIがいかに役立つかを示している。また、最終的には完全なバーチャル世界でロボットを訓練できる可能性も示している。この研究成果は、先週開催されたロボット学習学会(CoRL)で発表された。

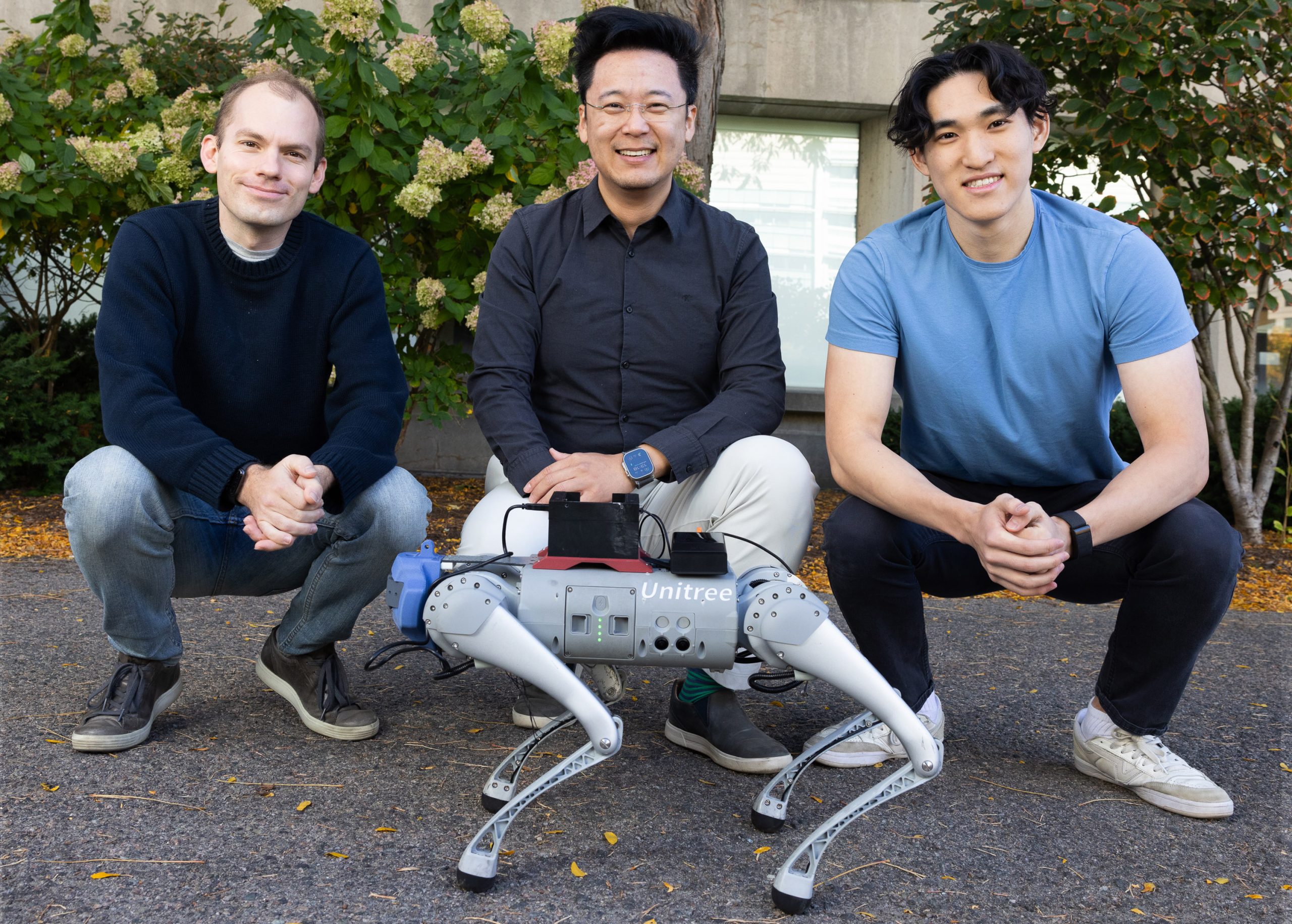

「私たちはいま、ロボット工学の産業革命の真っただ中にいるのです」。プロジェクトに携わったマサチューセッツ工科大学(MIT)コンピューター科学・人工知能研究所(CSAIL)のゲ・ヤン博士研究員は言う。「この研究は、これら生成AIモデルが本来の目的以外に与える影響を理解しようとする試みであり、これが次世代のツールやモデルの開発につながることを期待しています」。

ルーシドシムは、生成AIモデルを組み合わせて視覚訓練データを作成する。まず研究者たちは、チャットGPT(ChatGPT)向けに何千ものプロンプトを生成し、さまざまな天候、時間帯、照明条件など、ロボットが現実世界で遭遇する多様な環境を表す説明をChatGPTに作成させた。例えば、「伝統的な装飾品や書が飾られている茶店や小さく趣のある店が軒を連ねる古い路地」や「枯れ草が点在する、やや手入れが行き届いていない芝生を太陽が照らしている」といった説明である。

これらの説明は、3Dジオメトリと物理データをAI生成画像にマッピングするシステムに入力され、ロボットがたどる軌道をマッピングした短い動画が作成される。ロボットはこの情報をもとに、箱や階段など、移動しなければならないものの高さ、幅、奥行きを計算する。

研究チームはルーシドシムの試験で、Webカメラを装備した4本足ロボットに道路コーンやサッカーボールを見つける、箱を乗り越える、階段を上り下りするなど、いくつかのタスクをこなすよう指示を出した。ロボットは、従来のシミュレーションで訓練されたシステムを使った時よりも一貫して優れたパフォーマンスを発揮した。コーンの位置を特定する20回の試行で、ルーシドシムの成功率は100%だったのに対し、標準的なシミュレーションで訓練されたシステムは70%にとどまった。同様に、ルーシドシムは別の20回の試行で、85%の確率でサッカーボールに到達したが、他のシステムではわずか35%にとどまった。

最後に、ロボットがルーシドシムを使って階段を上る試験では10回の試行すべてを成功させたのに対し、他のシステムでは成功率が50%にとどまった。

COURTESY OF MIT CSAIL

この研究に携わったMITのフィリップ・イソラ准教授は、ルーシドシムが言語、画像、物理モデルの寄せ集めではなく、より洗練された映像生成モデルから直接情報を引き出すなら、これらの結果は将来さらに改善される可能性が高いと語る。

ニューヨーク大学の博士課程生で、AIモデルを使ったロボットの訓練に取り組んでいるマヒ・シャフィウラーは、今回の生成AIを活用した研究者たちのアプローチは斬新で、より興味深い新しい研究への道を開くだろうとは語る(なお、シャフィウラーはこのプロジェクトには関与していない)。

「個人的にもっと興味深い方向だと思うのは、現実のデータと現実的な『想像上』のデータの両方を混ぜることです。これにより、データを大量に消費する現在の手法をより迅速かつ適切に拡張できるようになるでしょう」とシャフィウラーは言う。

AIが生成した状況やシナリオのみでロボットをゼロから訓練できる能力は大きな成果であり、機械だけでなくより汎用的なAIエージェントにまで拡張できる可能性があると、ファーウェイの上級研究科学者で、脳に着想を得たAIを専門とするザフェイリオス・ファウンタスは言う。

「ここでの『ロボット』という言葉は非常に広義に使われているものです。現実世界とやりとりするある種のAIについて話しているのです。これが、ロボットや自動運転車からコンピューター画面やスマホの制御まで、あらゆる種類の視覚情報のコントロールに使用されることが想像できます」。

次のステップとして、研究チームは合成データのみを使用して人型ロボットをトレーニングすることに興味を持っている。2足歩行ロボットは、一般的に4足歩行ロボットよりも安定性が低いことから、それが野心的な目標であることを認識している。また、別の新しい課題にも目を向けている。ルーシドシムを使って、工場やキッチンで働くロボットアームのようなものを訓練することだ。これらのロボットが実行しなければならないタスクには、風景の中を走り回るよりもはるかに高い巧妙さと身体的理解が求められる。

「実際にコーヒーカップを手に取って注ぐことは、非常に難しい未解決の問題です。生成AIで拡張されたシミュレーションを利用して多様性を生み出し、カフェで活動できる非常に安定したエージェントを訓練できれば、それはとてもすばらしいことだと思います」。

- 人気の記事ランキング

-

- This company claims a battery breakthrough. Now they need to prove it. すべてのパラメーターが矛盾——「出来すぎ」全固体電池は本物か?

- OpenAI’s “compromise” with the Pentagon is what Anthropic feared アンソロピック排除の裏で進んだオープンAIの軍事契約、その代償は

- AI is rewiring how the world’s best Go players think 「アルファ碁」から10年、 AIは囲碁から 創造性を奪ったのか

- How uncrewed narco subs could transform the Colombian drug trade 中には誰もいなかった—— コカイン密輸組織が作った 「自律潜水ドローン」の脅威

- リアノン・ウィリアムズ [Rhiannon Williams]米国版 ニュース担当記者

- 米国版ニュースレター「ザ・ダウンロード(The Download)」の執筆を担当。MITテクノロジーレビュー入社以前は、英国「i (アイ)」紙のテクノロジー特派員、テレグラフ紙のテクノロジー担当記者を務めた。2021年には英国ジャーナリズム賞の最終選考に残ったほか、専門家としてBBCにも定期的に出演している。