この記事は、『AI白書2023』(角川アスキー総合研究所刊)の転載です。

認証AI、推薦AIや生成AIなどが、さまざまな場面で利用されつつある中、AI原則を実践に移して適切な開発・運用や利用をするための議論が進んでいる。欧州連合(EU)が雇用や教育、法執行などのハイリスクな場面での利用を含む包括的なAI規制を目指しているほか、認証やリスク評価といった方法論なども多くの国の機関が提唱をしている。機動力のあるマルチステークホルダーの議論の場である「AIに関するグローバルパートナーシップ(Global Partnership on AI:GPAI)」では現在、何が議論されているのだろうか。GPAIの現状や今後の方向性を含めて、各作業部会(Working Group:WG)に参加している専門家に聞いた。

【出席者】

市川 類 一橋大学イノベーション研究センター教授:WG「イノベーションと商業化」

実積寿也 中央大学総合政策学部教授:WG「責任あるAI」

羽深宏樹 京都大学大学院法学研究科特任教授:WG「データ・ガバナンス」

原山優子 東北大学名誉教授:WG「仕事の未来」

【司会】

江間有沙 東京大学未来ビジョン研究センター准教授:WG「仕事の未来」

◆

専門家を主体に多様なステークホルダーが議論を交わすGPAI

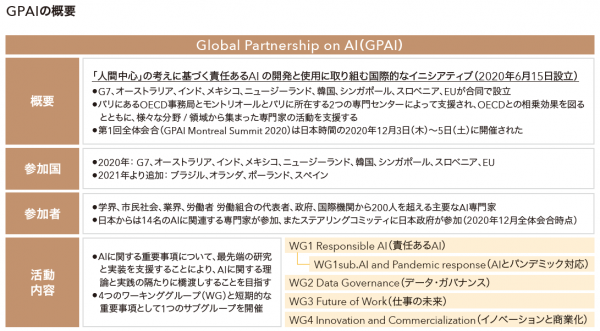

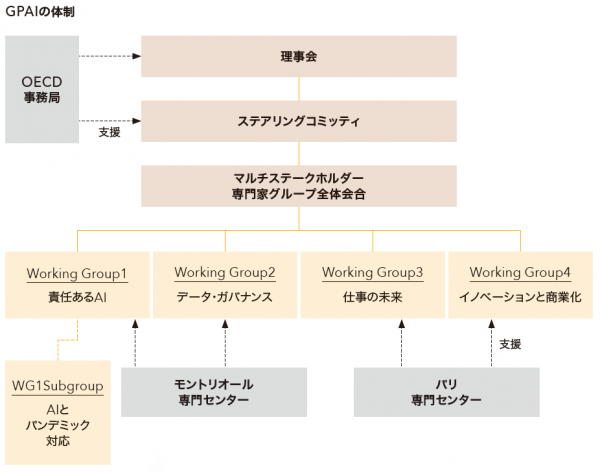

江間 GPAIは人間中心の考え方に立ち、「責任あるAI」の開発・利用を実現するために2020年に設立された、価値観を共有する政府・国際機関・産業界・有識者等からなる官民国際連携組織です。

現在、4つのテーマ、①責任あるAI (Responsible AI)、②データ・ガバナンス(Data Governance)、③仕事の未来(Future of Work)、④イノベーションと商業化(Innovation and Commercialization)について、WGが設置されており、専門家による議論がなされています。昨年の2022年11月には第3回目となるGPAIサミットが東京で開催されました。

今回は立ち上げからGPAIに携わっている原山優子先生、WG「責任あるAI」に携わっている実積寿也先生、WG「データ・ガバナンス」に携わっている羽深宏樹先生、 WG「イノベーションと商業化」に携わっている市川類先生にご参加いただき、GPAIで何が議論されているのか、その現状と今後の方向性についてご解説・ディスカッションしていただきたいと思います。なお私もWG「仕事の未来」のメンバーです。

東京大学大学院総合文化研究科広域科学専攻博士課程修了(学術)。京都大学白眉センター特定助教、理化学研究所革新知能統合研究センター客員研究員、東京大学政策ビジョン研究センター特任講師を経て、現在、東京大学未来ビジョン研究センター准教授。日本ディープラーニング協会理事。

まずGPAIがどのような組織で、どのような国や組織から成り立っているのかを、ステアリングコミッティの委員を務められた原山先生からご説明いただけますか。

原山 GPAIの枠組みは、G7サミットが核になっています。2016年に日本がG7の議長国を務めたときにG7香川・高松情報通信大臣会合があり、そこでAIの位置付け、研究開発する上での原則が必要だといわれたのが出発点でした。年を経るごとに具体的な議論の枠組みをつくる機運が高まり、最終的にはカナダとフランスがリーダーシップをとることで、2020年6月、新たな国際的な枠組みとしてGPAIがスタートしました。当初はG7に加えて7か国とEU、計15の国と地域が参加しました。今は29か国になり、今後も増えていくと考えられます。

AI原則、ガバナンスに関しては経済協力開発機構(OECD)やユネスコ(国際連合教育科学文化機関:UNESCO)でも様々な議論をしていますが、GPAIは専門家が主体となり、原動力となっているところが国主導、委員会主導の枠組みと異なるところです。また、GPAIは参加国ではない国籍の人でも手を挙げて専門家として参加することが可能です。マルチステークホルダーの中には、政府関係者だけでなく、多様な専門性を持つ研究者、民間の方、労働組合なども含まれ、多様性を基軸とした体制が特徴です。

GPAIの目的は、より現実的な、現場に近い課題を議論しながら、同時に理論的なところとのギャップを縮めていくことにあります。一律のルールをつくるのではなく、多様性を許容しながら様々な国の中で共通する “何か”を見出そうとする価値観が、非常に面白いと思っています。

江間 今、OECDやユネスコといった国際機関の話がありましたが、その辺りに関わってこられた実積先生、経緯やGPAIとの相違点をお話しいただけますか。

実積 原山先生がお話された通り、GPAIは専門家がベースの枠組みであることが、国際機関との大きな違いです。専門家チームは各国が推薦した人たちが中心となっていますが、国が専門家の発言に対して制約を加えることはなく、あくまでも専門家が自らの考えに従って議論しています。各国の政策当局の意向を慮ることなく自由に議論できる分、合意した内容がそのまま政府の政策や民間企業への規律になるような仕組みにはなっていません。その「強制力のなさ」が、GPAIの限界だと感じます。その意味で、大きな「学会」と考えるとわかりやすいかもしれません。

EU、米国で進む AI 規制・法制化の動き

江間 現在、「原則などのガイドラインから実践へ」という流れの中で、AIガバナンスをハードローで行うか、ソフトローで行うかといった議論も行われています。羽深先生にうかがいたいのですが、欧州や米国では具体的にどのようなガバナンス体制の議論がありますか。

羽深 この先1、2年は、各国においてAI原則を具体的な法規制、あるいは実務上のガイドライン等に落とし込んでいく非常に重要な期間になると見ています。EUではAI Actのドラフトが2020年に公表され、具体化に向けた議論が目下進行中です。また米国では、2022年にホワイトハウスがAI権利章典(AI Bill of Rights)を出しました。議会でもAlgorithmic Accountability Actという法案が両院に提出されています。カナダもArtificial Intelligence and Data Actという法案を提出しています。

ただ、そうした法制化の動きがありつつも、まだ具体的に事業者が何をすれば良いのかは正直よくわからないのが現状です。例えば、AIリスク評価とは具体的に何をすれば良いのか。法文の中である程度具体化されると思いますが、詳細は民間がつくるソフトロ ーとしてのガイドラインや、ベストプラクテ ィスを参照するケースが多分に出てくるでしょう。

それらが今後、どれだけレギュレーションの中に取り込まれていくかが非常に重要なポイントになると思います。ハードロー、ソフトローの両輪をにらみながら日本としてのポジションを決めていく必要があるかと思います。

江間 機動力がある枠組みである一方、国といかに連携していくかが今後の課題になりそうだということが、これまでの話で浮き彫りになりました。そういう点を考えると、各国の事情や国際情勢を注視して背景を知っておかなければ、実態をとらえ損ねる可能性もありそうです。

市川先生は2021年に開催された第2回のGPAIサミットに参加されています。背景となる国際情勢や今の技術的な動きなどを含めて、着目すべき点を共有いただけますか。

市川 EUのAI Actは、一昨年の春にドラフトが出て、当初は半年程度で法案が確定するといわれていたにもかかわらず、現在1年半以上経ってもまだ確定しない状況にあり、 EUの中でもまだ多くの意見が交わされていることがうかがえます。一方、米国でも、 AI権利章典や法案が出るなど積極的な動きがみられます。これはトランプ政権からバイデン政権になったことに加え、米国とヨーロ ッパの間で貿易技術評議会(TTC)が定期的に開催されるようになり、その中でも、SNSやフェイクニュースなども含めたデジタル関係、とりわけAIの分野で連携して対応しようという国際的な流れの上にあります。

東京大学大学院総合文化研究科(広域科学)修士課程、マサチューセッツ工科大学技術・政策プログラム修士課程、政策研究大学院大学科学技術イノベーションプログラム博士課程をそれぞれ修了。1990年、通商産業省(現:経済産業省)。JETROニューヨーク情報技術部長、内閣官房情報通信技術(IT)総合戦略室内閣参事官、産業技術総合研究所人工知能研究戦略部長等を歴任。現在、一橋大学イノベーション研究センター教授。

もう一つ面白いのは、英国はEUから離脱したことを契機に、むしろAI Actのような厳しい法律はつくらない方向へ向かっていることです。英国政府は「プロイノベーティブな規制手法(pro-innovation approach to regulating AI)」という報告書を2022年7月に発表し、部分的に法規制はあるにせよ、できる限り自主的にやりましょう、という趣旨の方向を提案しています。2022年11月のGPAIサミットでは、自主的な方向を志向する日本とシンガポールと英国の3カ国でのサイドイベントが開催されました。AIに対して「恐れ」があり、ゆえに規制が必要という考え方を持つ欧州の人たちと、間違った使い方をしなければ必ずしも規制は必要ないと考えるアジア圏の人たちでは、かなり距離があります。そういう文化的な違いがある中で、議論が深化していくものと思っています。

2023年のトピックとしては、ウクライナでの話(AIの軍事利用)もありますが、一部のシンクタンクの人は、生成AIが地政学上今年3番目くらいの課題になるのではないかと指摘しています。これはAIの話というよりも、SNSを含めたデジタル社会がどうなるかという話に近いのですが、そういった観点も含めた議論が重要になってくるでしょう。

議論を各国の政策や規制に落とし込む「強制力」を高めることが課題

江間 ここからは、それぞれのWGでの議論や決定されたことについてうかがいたいと思います。その前提として、原山先生、GPAI全体の今後の方向性についてご説明いただけますか。

原山 私自身は、ステアリングコミッティのメンバーだったのは昨年のサミットまでなので、今は卒業したという位置づけです。昨年の経験を踏まえてお話しさせていただくと、GPAIに参加する専門家は基本的にいずれかのWGに所属しますが、専門家全体をまとめる組織としてMEG(Multistakeholder Expert Group)があります。そのMEGが、 GPAIの活動の総括と方向性を示すものとして今回初めて年次レポートを出しました。

このレポートは、単にこれまでの議論を記録するだけでなく向き合うべき今後の課題についても言及しており、メンバー国が自国へ持ち帰り、AIの論点として活用したり、状況によっては国レベルでの制度化の議論にも役立てていただきたい、そういう意図でつくられました。先ほど話のあった「強制力がない」という課題に対して一つの解になると考えます。

もう一つの今後の方向性としては、GPAIに参加している国はグローバル・ノースが多いので、グローバル・サウスもこれから巻き込んでいく必要があるという議論です。そういう意味で包括的に各国の動きを見ていくのが、今後の流れになっていくと考えます。

江間 MEGという専門家を集めた組織もありつつ、もととなっているのは各国の活動ということですね。ではWGではどのような議論があり、進展があったのでしょうか。まずは「責任あるAI」について実積先生からご説明いただけますか。

実積 WG「責任あるAI」では、国連のSDGs (持続可能な開発目標)への貢献を念頭に、「人間中心のAI」をどのように開発すべきかについて提言や研究を行います。

東京大学法学部卒業、ニューヨーク大学経営大学院修了(経営学修士)、早稲田大学大学院国際情報通信研究科修了(国際情報通信学博士)。郵政省(現総務省)、長崎大学、九州大学大学院経済学研究院教授を経て、2017年から中央大学総合政策学部教授。

現在65名の専門家が参加し、11名のオブザーバーがいます。初年度はWG全体でAIルールに関する現状をレポートにまとめました。そのレポートでは、各国のAI利活用原則がどのようになっているかを調査し、WGの観点から望ましいと思われた原則を分析しています。その中には、日本の総務省のものと経済産業省のものも一つずつ含まれています。

その後、4つプロジェクトを立てて、各自が興味のあるものに参加して議論を進めています。プロジェクトの一つ目は気候変動問題に対してAIをどう活用すべきかを、2つ目は、当時パンデミックが広がっていたことから新型コロナウイルス感染症の新薬開発にAIをどう活用していくべきかを議論しました。3つ目は、創薬全般に関してAIをどう活用していくかがテーマです。これら3つに関しては、AIを活用する上で注意すべきことなどを提言としてまとめています。

私が参加していた4つ目のプロジェクトは、SNSで使われているAIによるレコメンデーションシステムが、ユーザーや世論に及ぼす影響がテーマでした。SNSのレコメンデーションシステムがユーザーを極端な内容のコンテンツに引き寄せて、世論を過激な方向に誘導するのではないかという仮説に基づき、現状に関するファクトファインディングを行うことをまずは目指しました。2019年にクライストチャーチ・テロ事件があったことから、ニュージーランドでの実施を目指し、Twitter社をはじめとするSNS各社との協力関係の構築を試みていますが、現在はなかなかうまくいっていません(編集注:2019年3月のニュージーランド・クライストチャーチ・テロ事件では、実行犯により銃撃の様子がSNSで生中継、ライブ配信され、オンライン上で瞬時に拡散された。テロリストによるインターネット悪用問題は国際社会においても喫緊の課題と位置づけられ、クライストチャーチ・コール宣言〔The Christchurch Call to Action:CCA〕」がとりまとめられた。日本もこの宣言を支持している)。

ここから先は、各国政府に我々の提言を採用してもらう、あるいは提言を視野に入れた上で法制化してもらうよう働きかけるという方向に向かって作業が進むと予想しています。民間企業を含めた多くのステークホルダーの方々に我々の活動に興味を持っていただき共に望ましいガイドラインをつくる、あるいは可能であれば、GPAIでの我々の提言を採用してAIのガバナンスに反映していただく、といった方向へ進んでいけば理想的です。

江間 ありがとうございます。続いて、「デ ータ・ガバナンス」について羽深先生、お願いいたします。

羽深 WG「データ・ガバナンス」は、37名の専門家と6名のオブザーバーで構成されています。2022年度は、主に3つのプロジェクトで検討を行いました。1つ目は、データトラストを通じた社会的利益のためのデータ共有の実現がテーマです。2つ目は、データジャスティスというコンセプトに関する研究と実践の推進、3つ目は、PETs(Privacy Enhancing Technologies)と呼ばれるプライバシー保護の技術に関する実装的なプロジ ェクトです。

1つ目のプロジェクトでは、公共の目的で必要なデータをシェアするためのデータ・インスティテューションの構造の検討や、利益状況の整理を、実証的な実験に基づいて行うことを企図しています。プロジェクトの一例として、ナイジェリアにあるチャド湖が、気候変動によって約90%縮小しており、周辺住民に多大な影響が出ている問題があります。現地の組織と協力しながら、気候変動に関するデータの収集、管理、共有、利用等の枠組みを整備し、AIを用いて周辺住民が気候変動に対応できるようにしようというプロジェクトです。

2つ目のプロジェクトは、コンセプトの整理が中心でした。データジャスティスという概念は非常に“攻めた”コンセプトです。これまでデータに関する個人の権利というと、例えば「事前に同意を取る」とか「自分に関するデータをコントロールできるようにする」といったことがいわれてきました。しかし現実的には、個人がデータに対するコントロールを握っていても、個人の利益の確保という観点からは十分でないことがわかってきました。より積極的に個人が自分のデータからもたらされる利益を享受したり、問題が起きたときに集団的に権利を行使できたりする状態を目指し、より積極的な権利を個人に与えようという概念整理が行われました。

3つ目のPETsに関するプロジェクトは、1つ目と同様に実証実験的なプロジェクトです。実積先生からご紹介いただいた、パンデミックの人流に関する影響のモデル化を「責任あるAI」WGと協力しながら、今後実験していくことになります。パンデミック対策という公的な目的に対して、個人の行動パターン等を読み取られないようにしながら、データを有効活用していくための検討が期待されるところです。

江間 WG間の連携があるのも、専門家同士が柔軟に動けるからなのでしょう。次に「仕事の未来」について原山先生、お願いします。

原山 AIの導入による影響が高いとされるのが、仕事の世界です。WG「仕事の未来」では、すでに仕事の場にAI導入が進む中、実際に現場で何が起こっているのかファクトを把握するところからスタートしました。

スイス・ジュネーブ大学教育学博士課程および経済学博士課程修了。教育学博士、経済学博士。ジュネーブ大学経済学部助教授、東北大学大学院工学研究科教授、経済協力開発機構科学技術産業局次長、総合科学技術・イノベーション会議常勤議員、理化学研究所理事を歴任。現在、日本科学振興協会(NPO法人)代表理事。東北大学名誉教授。

まずは事例集めを先行して走らせました。この「職場における観測プラットフォーム」プロジェクトでは、未来の仕事の牽引者になる現役の学生の方たちにAIを導入している企業にインタビューしてもらい、そこで現状の把握と課題を収集し、その情報をWG内で共有し、分析することを実践しています。今後、集めたデータを専門家にリファレンスとして見ていただけるよう、プラットフォームの構築を進めています。

その次に取り組んだのがプロジェクト「公平な仕事のためのAI」です。AI導入後も仕事場において公平性を担保するための基本的な原則をマルチステークホルダーのアプローチで抽出することを目的としています。AIによって仕事の現場が変化していく中で、効率を追うだけではなく倫理的な側面、バイアス、労働者に対する負荷などへの配慮が欠かせないという議論が出発点にありました。調査と議論の中から十の原則を導き出し、それをマルチステークホルダーの枠組みで検討した上で取りまとめたものを、2022年11月のGPAIサミットで発表しました。

2年目からスタートしたプロジェクト「AIリビングラボ」では、AI導入後、仕事の現場がどのように変化していくのかという問いに対して、情報の共有、議論、模擬実験の場を提供することを目指し、インドが中心となってバーチャルなリビングラボの実装に向けた取り組みをしています。こちらも学生を巻き込みながらミニリビングラボの開発を進めており、そのプロトタイプを2022年11月のGPAIサミットで紹介しました。様々な国の人たちの価値観やプラクティスが共有され、意見を交わす場であると同時に、アイデアを実験的に試す場にしていこうとしています。

江間 最後に「イノベーションと商業化」について市川先生、お願いできますでしょうか。

市川 WG「イノベーションと商業化」にはメンバーは約50名いますが、毎月会合に出てくるのは10 ~ 20名ほどです。プロジェクトは3つ進められており、2023年から新たにもう一つ加わります。このWGの取り組みを大きく2つに分けると、一つの柱は中小企業、もう一つは制度面になります。

AIの利用を促進する上では、中小企業での利用拡大が一番の課題です。そこで、中小企業とAIプロバイダーのマッチングポータルをつくりました。併せて、中小企業が「どの程度AI-Readyか」を自分で評価できる仕組みをつくったり、AIプロバイダーが倫理面を含めてどこまで対応ができているのかを確認できるチェックリストをつくったりもしています。シンガポール、フランス、ドイツ、ポーランドで実証を行い、そこで見えてきた課題を含めて今、修正しているところです。また、中小企業が多い農業分野でのAI利用促進のためのプロジェクトも進められています。

制度面では、知財プロジェクトがあります。最初の年は、初心者向けということで、 AIに関わる知的財産の関係を整理するとともに世界の主要国の現状をレポートにまとめました。また、昨年からは、AIの学習用のデータのIP上の扱いに係る各国ごとの実態調査を行うとともに、今は、つくった学習済みAIのモデルに係る知財の扱いについて検討を進めています。2023年からは、新しく始まる制度面に係るプロジェクトとして、 AIを規制しつつイノベーションを促進するためにどうすれば良いかを議論していきます。

あとWGの運営で気になることとしては、参加者の大半は欧州の専門家であり、オンラインで会議をすると、それに加えて米国から参加する人がいる程度です。そのため、各国比較などの作業では、欧州と米国が中心となり、それ以外で、貢献してるのが日本くらいです。日本が含まれていることによって、何となくグローバルとしてのGPAIの形が保たれているのが現状かなと思っています。

GPAIはさらなる多様性へ。日本からの参加も求められている

江間 原山先生がおっしゃったように、今後、参加国は増えていくだろうと思います。できれば、参加していくステークホルダーの人たちも増えていってほしいですし、実際にその国の政策につなげていくには、各国省庁、国際機関の関係者にも入っていただくことが望ましいと思っています。

最後に、GPAIに対する提言と、GPAIについてご存じない方に向けて、メッセージがあればいただけますでしょうか。

実積 先ほど市川先生から、実質的な貢献国の数が少なくなって欧米中心に進んでいるという話がありましたが、WG「責任あるAI」もまさにその状態です。日本やアジアからの参加が少ないため、毎回のオンライン会合が日本時間の朝4時開始などに設定され、実際問題としてリアルタイム参加は困難です。

日本からの参加者が少なくなってしまう理由の一つとして、検討してもせいぜい拘束力のない「提言」にしかならないのだからと、真剣に取り組まれていないことがあると思っています。これをどうにかして変えたいですし、逆にそこが変わらないと、日本政府としてもGPAIを活用しようということにならないでしょう。

WGの観点からお話しすると、「責任あるAI」の原則を実際に運用するのは政府ではなく民間企業です。民間企業の側から進んでGPAIの提言を取り入れる状況をつくることが必要だと考えています。そのためには消費者の間で、例えば「倫理性のあるAIのほうがより品質の高いサービスだ」というような共通認識が広がることが望ましく、そのことが企業の行動に影響を及ぼして、AIガバナンスを実質的なものにしていくはずです。

倫理性があるAIと倫理性がないAIの2つがあるならば、後者を選択する方がメリットがあることが社会の常識になる必要があります。「責任あるAI」の価値に対するアウェアネスを全体的に上げていかなくてはならないとも思います。専門家や企業のみならず、消費者の協力が必要な部分です。

羽深 GPAIというよりは日本への要望かもしれませんが、「何のためにやっているのか」をそれぞれの関係者が明確にしないと、なかなかサステナブルな仕組みになっていかないと考えています。日本国内の議論だけを見ると、国民のAIに対する問題意識は欧米と比べると必ずしも高くなく、直ちにAIを規制しようという機運もありません。そのような中で、なぜ国がAIやデータに関する消費者の権利を検討するのか。その辺りを整理していく必要があると思います。

東京大学法学部卒、東京大学法科大学院修了、スタンフォード大学ロースクール修了。弁護士(日本・ニューヨーク州)。経済産業省商務情報政策局情報経済課ガバナンス戦略国際調整官、東京大学公共政策大学院非常勤講師等を経て、現在、京都大学大学院法学研究科特任教授、スマートガバナンス株式会社代表取締役CEO。

もちろん、国民の問題意識が高まっていないからといって、AIガバナンスに関する問題を無視して良いわけではありません。この手のものは、じわじわと外堀が埋まり、いつの間にかグローバルスタンダードができて、日本が気づいたときには世界から後れを取ってしまうケースが他の分野でも多々あるからです。AI規制のようなホットなトピックに対しては、日本がよりグローバルなルール形成に参画できる機会をつくっていく必要があるでしょう。

先ほど、実積先生がおっしゃっていたように、企業側からも人を出すとか、お金を出すことも、将来的には検討されると良いと思います。官民がうまく連携して、日本がよりグローバルなルール形成に参画できる機会をつくっていくことが重要だと思います。

原山 少し別の視点から、GPAIそのもののガバナンスの課題について指摘させていただきます。今後GPAIは、サステナブルな組織にできるか、既存の国際会議との違いをいかに出していくかが課題だと思っています。

GPAIのWGの事務局は、パリとモントリオールにある研究機関(INRIAとCEIMIA)がサポートする体制になっているのですが、それだけで持続可能なのかという議論がステアリングコミッティの中でありました。事務局機能を果たすINRIAとCEIMIAに加え、各参加国にあるAIに関する国立の研究所も参画する形でGPAIの活動に貢献していただくのが、これからの流れになると思います。 それから、参加国が増えることは、多様性のレベルが上がることに直結します。その結果、欧米だけの議論でなくなるのは良いのですが、共有する価値観をいかにキープしていくかが、逆に課題になってくると思います。その意味で、WGレベル、あるいはMEGレベルでも、「何が本質的な課題か」を全員参加型で議論できる機会をもっとつくっていかなくてはなりません。

また、日本では産学官連携という形がよくとられますが、そこでは「民」が抜けています。消費者、一般市民という意味の「民」です。GPAIのマルチステークホルダーの中には「民」も入っているので、日本の皆さんには多様性を実感する意味でもぜひ参加していただきたいですね。国内での議論とは違うものが見えてくるはずです。参加することで獲得できるものがあるので、それをまた持ち帰 って日本での議論に反映していただければと思っています。

市川 参加国が増えてきているのは確かです。ただ、実際に参加できているのはほぼヨ ーロッパ系の人たちで、新規国からは入りきれない人が多い印象です。WG「イノベーシ ョンと商業化」では、アジアで出てくるのは日本とシンガポールくらいで、あとはインドが入るかどうか、といったところです。やはりもう少しアジアのメンバーを増やしたいですね。

これはGPAIへの提言というよりは我々がしなくてはいけないことなのですが、2022年、経済産業省の仲介の下、GPAIに関心があるグループに対してGPAIに係るプレゼンをしたことがあり、その結果、そのグループの中から自己推薦の枠で数名が、今年からGPAIのメンバーに新たに入って来られました。こういう動きをもっとしなければいけませんし、『AI白書』を読んでいる方の中で、国際的なAIガバナンスについて議論してみたい人があれば、ぜひ、お声掛けいただければと思います。

実積 欧州のGPAI参加者はOECDあるいはユネスコで議論をしている内容の延長線のような議論をGPAIでしています。欧州はGPAIをうまく活用していますね。残念ながらアジア各国や日本はそういった機会をうまく活用できていないというのが個人的な感想です。

原山 欧米の参加者は、OECDやユネスコなど、様々な他の会議でも同じような顔ぶれですからね。また、日本のAI開発企業の方からすると、GPAIとOECDとの違いがよくつかめないかと思われます。GPAIの創設時には、政策提言やルールメーキングはOECDが、GPAIはそれを受けて実装の議論にフォーカスするという棲み分けがありましたが、3年が経過した今、GPAIにおいても、時として政策提言に踏み込む必要があるという専門家からの指摘もあって、ある種の歩み寄りが始まったところです。

江間 GPAIは、多様な人々が参加でき、いろいろな議論を交わせる枠組みが「手に届く所にある」ことが良い点だと思います。本日は非常に盛りだくさんな内容をありがとうございました。

(本座談会は2023年1月、オンラインで実施した)

◆

この記事は、『AI白書2023』(角川アスキー総合研究所刊)の転載です。AI白書2023では、「生成AIのインパクトとAIガバナンス」をテーマに、ChatGPTなどの生成AI関連のトピックス、キーパーソンへのインタビューや対談、中国企業における開発・利用動向、国内のAIベンダー企業への AI開発実態調査などを掲載しています。詳しくは公式サイトをご覧ください。

- 人気の記事ランキング

-

- The 8 worst technology failures of 2024 MITTRが選ぶ、 2024年に「やらかした」 テクノロジー8選

- Promotion Innovators Under 35 Japan × CROSS U 無料イベント「U35イノベーターと考える研究者のキャリア戦略」のご案内

- Bringing the lofty ideas of pure math down to earth 崇高な理念を現実へ、 物理学者が学び直して感じた 「数学」を学ぶ意義

- The 8 worst technology failures of 2024 MITTRが選ぶ、 2024年に「やらかした」 テクノロジー8選

- The next generation of neural networks could live in hardware 消費電力「数十万分の一」、ハード実装の次世代ニューラルネット

- AI白書編集部 [AI白書 編集部]日本版

- 『AI白書』(角川アスキー総合研究所刊)の編集部です。