ユーチューブが有害動画対策で新方針、脅迫「暗示」も禁止へ

ユーチューブが、人種差別や同性愛嫌悪の嫌がらせを野放しにしているという批判に対応した。だが、実際にそれを実行に移さなければならない。

12月11日、ユーチューブは嫌がらせに関するポリシーの改訂を発表した。改訂によって「人種、性別、性的指向に基づいて、他人を悪意を持って侮辱したり、中傷したりした」動画は削除される。さらに、「婉曲的あるいは暗示的な」脅迫や「身体的暴力が実際に起きる可能性を示唆する言葉」も禁止される。

極右のスティーブン・クラウダーが自身の(ユーチューブの)チャンネルでボックス(Vox)の記者に対して人種差別主義的かつ同性愛嫌悪的な言葉を使用していたのにも関わらず、投稿を禁止しなかったとしてユーチューブが非難されてから、約6カ月が経つ。ユーチューブは、クラウダーの発言はポリシーに違反していないと述べていたが、今回の改訂はその後に起きた反発に対処したものと見られる。

改訂ポリシーをどのように実行していくのか? わずかな人工知能(AI)と、新たに雇用する何千人ものモデレーター(コンテンツ監視者)に頼ることになる。モデレーターは動画を見て、問題のあるコンテンツがあるかどうかを詳しく調べる。しかし、ユーチューブのポリシー施行実績は、実際のところあまり褒められたものではない。

さらに、モデレーターの労働環境に関して問題があったのではないかともいわれている。その通りだ。今年の初め、ザ・バージ(The Verge)の調査によって、フェイスブックのモデレーターの深刻な精神衛生上の問題が詳細に報じられた。ワシントン・ポスト紙による別の調査では、ユーチューブのモデレーターも同様に苦しんでいることが分かった。レディット(Reddit)はAIによる「自動モデレーター」を使って人間のモデレーターの支援に取り組んでいるものの、システムは不完全であり、いまだ人間による見直しが必要だ。

ユーチューブは9月、児童オンライン・プライバシー保護法(Children’s Online Privacy Protection Act)に違反したとして、1億7000万ドルを支払うことで米国連邦取引委員会(FTC)と和解した。子どもが視聴する動画に関するデータを違法に保存し、使用していたことが理由だ。ユーチューブは、子ども向け動画にラベル付するシステムを作らなければならない。子どもを対象とした動画の場合、コンテンツ制作者は視聴履歴に基づいて広告費を集めたり、関心がある視聴者をターゲティングしたりできなくなる。

だが、子ども向けコンテンツとは実際にどのようなものなのか? 定義次第ではユーチューブにとっても多くのコンテンツ制作にとっても収入を失いかねないだけに、大きな関心を呼んでいる。特に、子どもにとっても魅力的なコンテンツである、アンボクシング動画(いわゆる「開封の儀」)やアニメーションなどのコンテンツに関して定義があいまいだ。12月11日、ユーチューブはFTCに宛に書簡を送り、FTCの方針が「複雑」であり、基準を明確にするよう要請した。今後、数カ月間は多くの法的混乱が予想される。

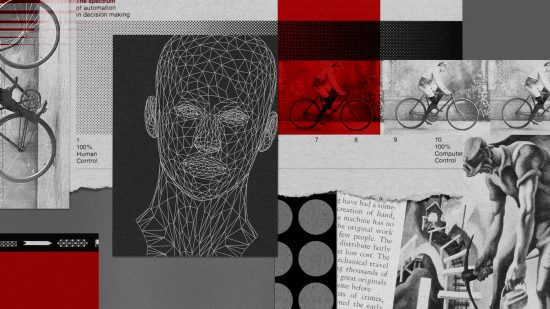

「テクノロジーは人をダメにする」プラトンも恐れた人類の葛藤の歴史

「テクノロジーは人をダメにする」プラトンも恐れた人類の葛藤の歴史  メディアの主役に躍り出た動画は、活字文化に終わりを告げるか?

メディアの主役に躍り出た動画は、活字文化に終わりを告げるか?

eムック「未来のミライ」 創刊125周年記念特別号

eムック「未来のミライ」 創刊125周年記念特別号

卵巣がんとの闘い

卵巣がんとの闘い 選挙干渉、AIより古典的手法が主流 米大統領選の対策は?

選挙干渉、AIより古典的手法が主流 米大統領選の対策は?